La conferencia de Nvidia (dos horas en YouTube) de ayer, con la compañía convertida ya por derecho propio en una de las grandes tecnológicas – es ya la tercera compañía con mayor capitalización bursátil – y ejerciendo como tal en el evento, comenzó con su fundador, Jensen Huang, saliendo al escenario con su icónica cazadora de cuero, alucinando ante la cantidad de gente convocada y diciendo eso de «espero que os deis cuenta de que esto no es un concierto», para después dar paso a una sesión de dos horas intensamente técnica, como corresponde a la compañía que es.

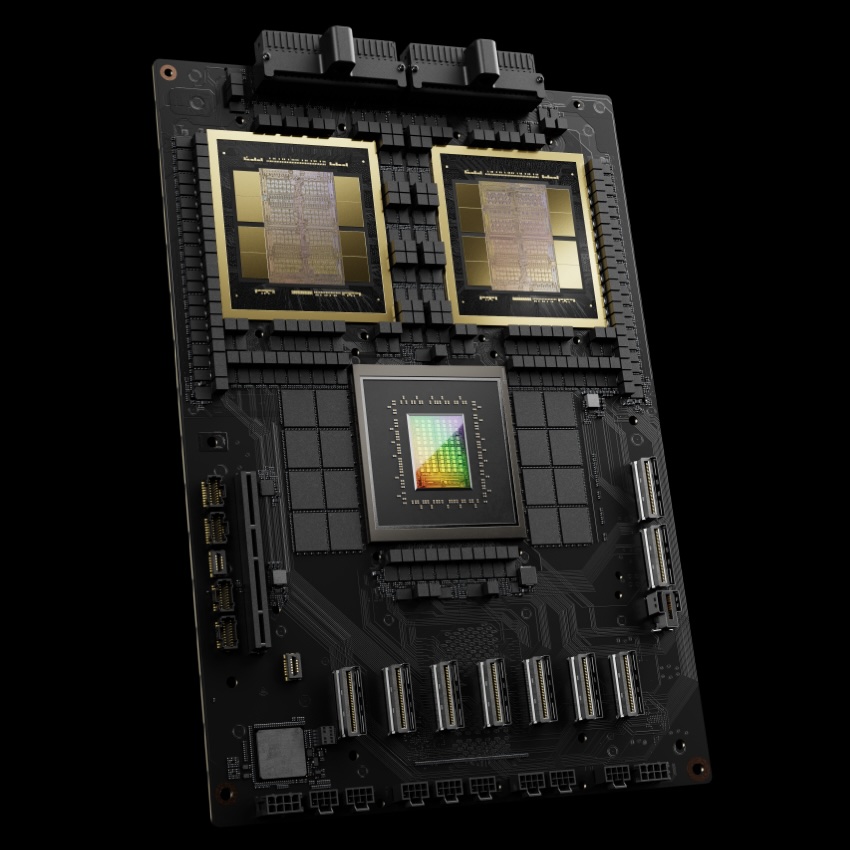

La conferencia tuvo verdaderamente de todo, y demostró que la compañía, como dije ya hace tiempo, sigue sin tener techo: por un lado, una nueva arquitectura que sucede a Hopper (nombrada en honor a «Amazing» Grace Hopper) y bautizada como Blackwell, en honor al matemático David Blackwell, que promete más que doblar la potencia de la anterior a cambio de un consumo unas veinticinco veces menor. Si los chips de Nvidia eran reconocidos por toda la industria como prácticamente la única alternativa razonable a la hora de construir sistemas para dar soporte a la inteligencia artificial, ahora lo es más aún, lo que sigue impulsando la valoración de la compañía.

Pero además, la conferencia tuvo un poco de todo, haciendo énfasis en algunas de las áreas de más fuerte desarrollo: desde modelos de predicción para la emergencia climática como Earth-2, hasta plataformas para el diseño de robots humanoides como Gr00t, pasando por plataformas de streaming hacia dispositivos de spatial computing como Apple Vision Pro, entornos para facilitar la puesta en producción de modelos de inteligencia artificial, o entornos de simulación de computación cuántica.

Es un posicionamiento corporativo que toca de lleno todas y cada una de las áreas de desarrollo más prometedoras del momento en computación, proporcionando un soporte cada vez más sólido a las expectativas de sus accionistas. Un éxito de la noche a la mañana fraguado con paciencia a lo largo de treinta años.

Además, algunas frases extremadamente interesantes: por un lado, el asesor general adjunto para temas legales de la compañía afirmando que no cree que las leyes de propiedad intelectual se puedan extender a las creaciones de modelos de IA generativos, algo que muchos pensamos desde el principio de toda la polémica sobre el uso de datos publicados en la red para el entrenamiento de modelos algorítmicos: si yo puedo pasearme por el mundo viendo todo tipo de cosas y leyendo lo que quiera y después puedo basarme en lo que he visto o leído para crear otras cosas, ¿qué sentido tiene empeñarnos en aplicar variaciones trasnochadas y claramente apolilladas del Estatuto de una tal reina Ana que vivió a principios del siglo XVII a estas alturas? ¿De verdad queremos, en un entorno en el que todo se mezcla y se remezcla como ocurre en nuestros cerebros, dedicarnos a trazar qué parte de una imagen aparece evocada en otra o qué fragmento de un escrito recuerda a otro o ha sido presuntamente reutilizado, cuando todos sabemos que no es así? ¿Queremos terminar, como los patéticos herederos de Marvin Gaye, cobrando porque algo supuestamente «evoca» o «recuerda» a alguien?

Por otro, una frase de Jensen Huang que me apunto para mis clases por lo contundente que me resulta:

Cualquier cosa que se pueda digitalizar. Siempre que haya alguna estructura en la que podamos aplicar algunos patrones, significa que podemos aprender esos patrones. Si podemos aprender esos patrones, podemos entender su significado. Cuando entendemos el significado, también podemos generarlo. Y aquí estamos, en la revolución de la IA generativa”.

Una explicación clarísima de cómo cambia el paradigma de la computación, y de sus fortísimas implicaciones. Tras décadas de emplear el software simplemente como un conjunto de reglas para introducir en él unos datos y generar unas respuestas, ahora pasamos a introducir los datos etiquetados con las respuestas que generaron anteriormente, y utilizamos la potencia de la computación para ser capaces de deducir las reglas que actuaron en ese paso. Si con eso sigues sin entender lo que viene y lo que tiene que hacer tu compañía, se dedique a lo que se dedique, en ese escenario, mucho me temo que te va a costar mucho entenderlo.

This article is also available in English on my Medium page, «Why the future belongs to Nvidia«

«Hardware is hard» pero en los últimos años..

Microsoft: Surface

Google: Pixel

Apple: Móviles, Portátiles, Gafitas

nVidia: Chips, GPUs

Amazon: Servidores

TSMC: Chips

Broadcom: Chips

Tesla: Coches

Samsung: De todo

Es decir, del top 25, hay un tercio dedicado a la informática de una forma u otra. Lo curioso es que en algunos el hardware viene tras el software y en otros el hardware lo es todo.

Al fin se ve que la visión de Apple de tener el control vertical de todo el proceso no andaba desencaminada.

Lo siguiente sería que nVidia ofreciera una versión de Linux que corra sobre una GPU para hacer servidores eficientes, hehehe

Las GPUs de NVIDIA hace años que son Linux friendly… ¡¡otro!!

https://www.nvidia.com/es-es/drivers/linux-supported/

Ultimamente los niños de 5 años tienen más comprensión lectora de lo que parece.

Lo que dice el abogado de nvidia es, que lo que producen los modelos generativos no puede registrarse como propiedad intelectual.

(Sic)

No dice que la información que se utiliza en su entrenamiento carezca de derechos de propiedad intelectual, sino lo contrario.

Yo ya no sé lo que pasa en algunos cerebros humanos.

Las leyes no se hacen a la medida o gusto de las creencias, como las matemáticas, son un álgebra social, con un cimiento formal y un marco fundacional.

–

Estoy de vuelta de Estambul y la ostia se ha oido aqui… XDDD

Por otro lado…

Droits voisins : l’Autorité prononce une sanction de 250 millions d’euros à l’encontre de Google pour le non-respect de certains de ses engagements pris en juin 2022

Droits voisins : l’Autorité prononce une sanction de 250 millions d’euros à l’encontre de Google

El asunto no es que lo creado por IA no tenga derechos de autor.

El asunto es como probar que algo no ha sido creado por IA, a no ser que eliminemos también todo tipo de derechos de autor y entonces a ver quien se molesta en crear nada.

Por ejemplo, si SUNO AI me hace una canción y la replico manualmente sin que quede rastro de la intervención de la IA, o hago eso y encima añado leves variaciones ¿quien puede probar que se ha hecho con IA?.

O si en lugar de leves variaciones, las hago de tal manera que la intervención de la IA sea anecdótica ¿cómo se calcula el porcentaje de la intervención de la IA para poder determinar si se tiene derecho a propiedad intelectual o no?

Y en caso de que nadie pueda ¿se va a eliminar todo tipo de derecho de autor , incluido el que cree algo por si mismo, para eliminar la posibilidad de que se haya ayudado con IA?.

En definitiva ¿se va a prohibir todo tipo de derechos de autor? ¿o se va a hacer en ciertos sectores y en otros no?.

La cosa es muyyyyy complicada.

Creo que esta compañía ha conseguido YA su superinteligencia famosa, pero sin mistiscimos idiotas, su capacidad de computo ha dejado atrás a la decrépita ley de Moore, hay un slide que muestra como ha crecido en una década. Desde luego que son el socio de referencia para todas las empresas del sector. Han sabido no ser un ecosistema cerrado (aprende Apple) y su HW hoy en día es imprescindible. Todos los que son y van a ser en la próxima década están su «Hall of Fame» que han mostrado: «Meta, Mistral, Oracle, Google, Amazon, Siemens, OpenAI, Microsoft, IBM/Redhat, SAP, BMW, Mercedes, Lenovo,…» Mucho me temo que algunos están perdiendo su tren por su propia decisión. ¿dónde están las compañías telefónicas?¿Dónde están las productoras de cine/TV?etc, etc

Se agradece su poco ruido y muchas nueces !!

“Creo que una de mis grandes ventajas es que tengo expectativas muy bajas. La mayoría de los graduados de Stanford tienen expectativas muy altas al graduarse en una de las mejores instituciones del planeta. El problema es que la gente con expectativas muy altas tiene muy poca resiliencia y, por desgracia, la resiliencia es muy importante en el éxito”, afirmaba Huang durante su intervención. “No sé cómo enseñároslo, salvo que espero que os toque sufrir”.

Pese a la aparente dureza de las palabras del directivo, matizaba. “Hasta el día de hoy empleo la frase ‘dolor y sufrimiento’ en nuestra empresa con alegría. Lo decía en un sentido positivo porque quieres entrenar y pulir el carácter de tu empresa. Quieres sacar grandeza de ella, y la grandeza no es inteligencia; la grandeza viene del carácter, y el carácter no se forma con gente inteligente. Se forma con gente que ha sufrido”.

“No sé cómo decirlo, pero a todos vosotros, estudiantes de Stanford, os deseo amplias dosis de dolor y sufrimiento”, bromeaba el directivo con su habitual buen talante.

Soy el primero en considerar que el Derecho de Autor precisa una profunda revisión, porque una ley pensada para controlar el numero de copias que se hacía, tenía sentido cuando reproducir una obra ,era algo laborioso que precisaba un caro y complejo proceso, (reunir una orquesta, colocar letra a letra los tipos para hacer un libro, copiar a mano una partituras en papel pautado,…), pero carece de sentido cuando todos tenemos en la intimidad de nuestro propio domicilio, sistemas perfectos reproductores de todo tipo de obras y es por ello resulta imposible controlar el número de copias, algo imprescindible para devengar los Derechos de Autor con la legislación actual..

No obstante opino que los creadores deben tener derecho a lucrarse de parte del dinero que consigan, quienes obtiene dinero mediante una reproducción de sus obra, Se que es complejo legislar esto, pero estoy seguro que en la entre los socios de la Sociedad de Autores habrá alguien en con una idea válida para aplicarla a los tiempòs que corren.

Sin embargo no distingo el medio utilizado por los autores para generar su arte. Igual puede ser un escultor cincelando el granito, un escritor aporreando un teclado, un fotógrafo que simplemente da un «click» a un botón, o ¿por qué no? quien es capaz de diseñar un «prompt» que genera una imagen, una melodía, o escribe una novela.

El arte está en dos cosas, haber tenido la intuición que permite imaginar la obra acabada, y la selección que hace el artista de lo que conviene enseñar al público y lo que conviene destruir por no ser tener la suficiente calidad. La herramienta con que construya su arte, no tiene importancia, sea el cincel y el martillo picando el granito, o el prompt que informa a la AI las características de la obra a realizar.

Yo, desde el día que he tenido que pagar «derechos de autor» por las casettes vírgenes que compraba para grabar audios particulares, no sólo siempre he esto en contra, sino que cualquiera que me los esgrima pasa a forma parte de de mi lista negra de enemigos a batir.

Pero tampoco me olvido de todos aquellos que no dijeron ni mú, en aquel momento, para luego gritar de dolor cuando se los cobraron en la era digital… Menudos merluzos.

Saludos

Cómo ha perdido este tren Intel. Si Andy levantara la cabeza..

Si no hace esto, Apple está jodida:

Su nueva serie de chips, M1-M3 no permite expansión de tarjetas gráficas.

Es cierto que en su interior tiene varias unidades de GPU integradas (hasta 80 creo, en las versiones superiores), pero siempre serán inferiores a las tarjetas dedicadas de Nvidia y su lenguaje de programación CUDA.

Por lo tanto, el M4 en adelante, debería permitir expansiiones por puertos PCI para poder «colaborar» con tarjetas externas como las de NVidia.

De todas maneras, dudo que lo hagan. Y tendrán que realizar sus LLMs en la nube como todo hijo de vecino aunque se empeñen en mantener la privacidad localmente en el dispositivo, no creeis?

Es lo que tiene ser un ecosistema «cerrado»… y muy cerrado: Apple Faces Antitrust Class Action Alleging iCloud Monopoly

No lo digo como «ataque», sino como obviedad.

Leo cosas muy contradictorias sobre Apple en este aspecto (IA) asi que de momento, no me pronuncio. Pero te doy la razon en que va a perder este tren si no se pone las pilas (o igual si lo esta haciendo… en silencio)

No tiene porque irle mal, Apple tiene su estrategia de ecosistema cerrado. Si fueran un poco listos, podrían ofrecer la computación IA en la nube como hace por ejemplo google con colab. Si no tienes un sistema preparado para correr con lo que se espera en local, lo haces como si tu MAC fuera un ChromeBook o un PC de hace 6 años.

Un usuario «complejo» no va a escoger un MAC para correr IAs y menos un gamer.

Es otro tipo de usuario que es fan de la marca y si obtiene pagando una mensualidad lo «mismo» con su Mac le va a dar igual. Hoy en día por ejemplo (por otras razones) nadie corre ChatGPT en local y es tan simple como tener los servidores en la nube (eso si corriendo Linux y NVIDIA).

Por 50$/mes por la nube, felices, de quitar la complejidad de instalar y trastear en el terminal. Es el camino que mucha gente fan elige pagar por no hacer ellos mismos.

(mkgo en el Grok y su p.madre… 297 Gb) XDDD

Descargando torrent… a ver si el fin de semana me pongo a ello… XDD

Alcanzar 20 petaFLOPS con las B200 o 40 petas con la GB200, ponen a NVIDIA mas allá. Por mas que estén surgiendo empresas como Cerebras o Rebellions, que sin duda provocaran mas avances, son muchos los años que llevan de ventaja y eso no es fácil de igualar. No digo imposible, digo muy difícil.

NVIDIA no es una empresa de las que consiguen un “éxito” y se columpian unos años viviendo de ello. Desde mi punto de vista, les queda aun mucho trecho para viajar en solitario.

Apenas hace un mes, presentó el superordenador EOS, 121,40 PFlop/s (Rmax) y 188,65 PFlop/s (Rpeak) que lo convierten en el noveno más potente del mundo. 18,4 exaflops, 576 plataformas DGX H100

Si el siguiente lo hacen con las B200 o las GB200 no quiero pensarlo…

Por otro lado, chupito, que voy a cantar China… XDDD

Ojito con los chinos, que la cosa de las sanciones les ha dado un chute de adrenalina que ya quisiera yo en algún videojuego…

OffTopic:

Un apunte eDans… ayer lei esto de MIT Technology Review. Seria interesante una de tus reflexiones.

El enigma de la IA generativa: hace cosas asombrosas, pero no sabemos bien por qué

En este paper publicado en 2001 los investigadores de aprendizaje automático de Microsoft demostraron que en realidad algoritmos muy diferentes, incluidos algunos bastante simples, funcionaban casi igual de bien en un problema complejo de lenguaje natural una vez eso si que se les proporcionaban suficientes datos. Lo que han hecho los del MIT es aumentar el tiempo de entrenamiento, es decir acercarse a un «overfitting», machacar a la IA con sumas, sumas, sumas, con lo que el resultado es que los LLM ahora saben hacer sumas,… no sé si el artículo es del MIT o del Mundo Today…

PS: Capítulo 1 del HOML…

Si lo veo desde una optica matematica/estadistica «a pelo»… no veo divergencias…

Lo estocastico me va de lado… lo cierto es que observando algunos modelos no me extraña este otro tratamiento de los resultados.

Sigo sin decir que si, y sin decir que no…. pero cuando los «creadores» hacen afirmaciones asi… es que «algo» hay… y no, no soy conspiranoico (y lo sabes).

El artículo del MIT, en resumen se han dado cuenta que la letra con sangre entra, dejaran la IA castigada en su habitación sin salir yaprendiendo, y YA SUMA !!!

Gracias Enrique por compartir tu análisis con el resto. Un saludo.