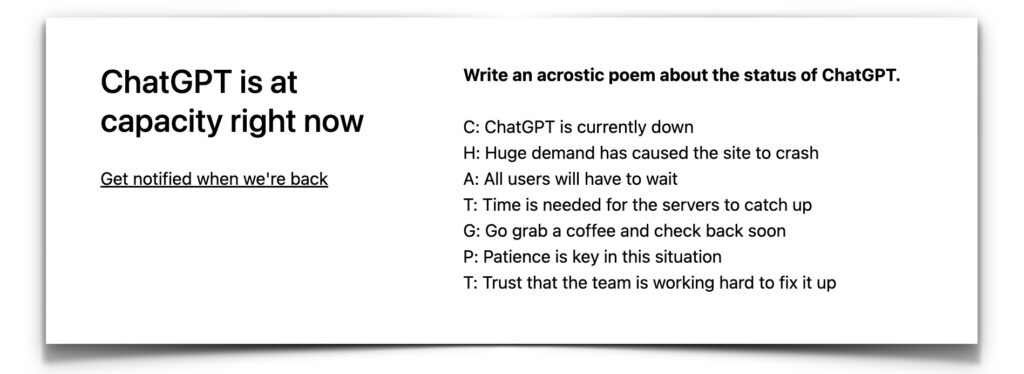

Sobre estas líneas, el mensaje de no disponibilidad que acabo de recibir de ChatGPT: un poema acróstico (con versos que comienzan por cada una de sus iniciales) que informa de que el chatbot conversacional no está actualmente disponible debido a una demanda muy elevada. En realidad, la cuestión la vi venir ya ayer por la tarde, durante una clase en la que utilicé ChatGPT extensivamente para ilustrar las posibilidades del machine learning, y en la que muchos de mis alumnos también se dieron de alta en el servicio para probarlo ellos: en algunos casos, recibimos varios mensajes de error y de falta de disponibilidad.

ChatGPT es, lisa y llanamente, el mejor chatbot basado en machine learning puesto a disposición del público en toda la historia, y su caída momentánea significa que, en este momento, medio mundo está actualmente intentando utilizarlo para intentar entender sus posibilidades y las consecuencias que puede tener para aquello a lo que se dedican. Desde profesores como yo, hasta personas con dislexia que lo utilizan para estar más seguros sobre los textos que escriben, pasando por todo tipo de desarrolladores y creadores de contenido, incluyendo el que en un ratito utilizó ChatGPT para escribir todo un libro de filosofía de cien páginas, ilustró su portada mediante Stable Diffusion, y lo puso a la venta en Amazon autoeditado en formato Kindle.

Una reacción de este tipo tiene, como podemos imaginar, muchas consecuencias, que no escapan a nadie que entienda el funcionamiento del machine learning: mientras aquellos carentes de visión tecnológica se quedan simplemente con que ChatGPT escribe textos al nivel de un estudiante de instituto de enseñanza media un tanto pretencioso, muy limitados, sin demasiado criterio con sus fuentes y sin mucho respeto por la realidad, los capaces de entender la dinámica del progreso tecnológico saben perfectamente que ese estudiante de enseñanza media está destinado a doctorarse Cum Laude en cuestión de no demasiado tiempo, y que su capacidad para hacerlo proviene, entre otras cosas, del número de personas que lo utilicen y lo alimenten incesantemente con más y más conversaciones. La caída ocasional de ChatGPT (unos minutos después he podido entrar y logarme perfectamente), en realidad, no esconde una incapacidad de la compañía que lo ha creado, OpenAI, sino una prueba de su genialidad.

Google, que cuenta con herramientas conversacionales similares como esa LaMDA que llevó a uno de sus ingenieros a pensar que había adquirido autoconsciencia hace pocos meses, decidió en contra de hacer un lanzamiento público precisamente por no tener claras cuáles podrían ser sus consecuencias, entre otras cosas, para su propio negocio de búsqueda. Como tantas veces ocurre en tecnología, ser prudente y esperar puede suponer la diferencia entre ser reconocido como el pionero de un concepto, o un segundón que se apunta al éxito del lanzamiento de un competidor.

Entre los muchos y muy interesantes debates generados, está el cómo diferenciar si un texto ha sido escrito por ChatGPT o por una persona. Potencialmente, ChatGPT es un muy buen impostor capaz de hacerse pasar por una persona, y lo será mucho mejor con el tiempo. La preocupación surge, entre otros, por profesores como yo, que solicitan en muchos casos a sus estudiantes ensayos sobre diversos temas como pruebas evaluables de las que depende su calificación. En mi caso, lo tengo claro: prefiero con mucho adelantarme al problema, instruir a mis alumnos en el uso de ChatGPT y algoritmos similares, y poder plantearme con tiempo cómo afrontar cambios en mis métodos de evaluación, a encontrarme más adelante con que su uso se ha convertido en generalizado y mis calificaciones han perdido su sentido.

Como tal, la respuesta es unívoca, y quien no lo entienda así, terminará lamentándolo: ChatGPT es una herramienta más, un disruptor, y como tal, su uso es completamente inevitable. Tenemos, por tanto, que aprender a gestionar nuestra actividad en un mundo en el que generar textos de cierta calidad aparente y de variada longitud sobre cualquier tema está al alcance de cualquiera. Que eso se haga como fuente de inspiración y se revise cuidadosamente después, o que simplemente se use Ctrl-C y Ctrl-V para intentar hacerlo pasar por un texto escrito por uno mismo es ya cuestión de ética y de objetivos. Los textos que genera son refritos de muchos otros textos incluidos en su base de datos, perfectamente capaces de ser pasados como originales, y de evadir las siniestras herramientas como Turnitin, iThenticate y similares que algunos profesores utilizaban actualmente (yo jamás lo he hecho).

Los intentos, por tanto, de desarrollar marcas de agua para poder reconocer los textos generados algorítmicamente de los creados por una persona me parecen limitados y destinados al fracaso, como vana me parece la decisión del gobierno chino de prohibir su uso sin tales marcas de agua para evitar que sean utilizadas de manera supuestamente indebida. En la práctica, siempre será posible utilizar el llamado «agujero analógico», simplemente tomando los textos generados y volviéndolos a teclear. Luchar contra el uso de una tecnología que ha probado su valor siempre ha sido una pérdida de tiempo.

Lo más difícil, en las próximas semanas, va a ser no escribir sobre ChatGPT y algoritmos similares. Sobre las consecuencias de tomar decisiones sobre la información a la que accede para generar sus textos, sobre el impacto que tendrá sobre las profesiones creativas, sobre los estudiantes que creen que pueden graduarse presentando trabajos hechos de esta manera, o sobre el primer caso de «inserte aquí la profesión que estime oportuna» que utiliza ChatGPT para llevar a cabo satisfactoriamente su trabajo.

Sin ser especialmente representativo de lo que es capaz de hacer el machine learning aplicado a la automatización avanzada de todo tipo de procesos (hay aplicaciones infinitamente más interesantes y que han generado mucho más valor), ChatGPT sí ha conseguido un asistente razonablemente bueno para la automatización avanzada de la generación de textos… y al hacerlo, ha conseguido que muchos se den cuenta de sus posibilidades, precipitando sin ninguna duda el proceso de adopción del machine learning como tecnología. Nos queda mucho, pero mucho por ver.

This article is also available in English on my Medium page, «Why does ChatGPT keep crashing? Because half the planet is trying to use it»

Permite hacer a escala lo que antes se hacía manualmente o con gran coste (siempre ha habido escritores que plagiaban o utilizaban ‘negros’, programadores que utilizan el código de otros o alumnos que pagaban para que les hicieran el trabajo de fin de máster), lo cual es la definición misma del avance tecnológico y el problema el de siempre: el uso que se haga del mismo.

programadores que utilizan el código de otros

Ese he sido yo, además incitaba a mis programadores a copiar lo que otros hubieran hecho antes,

La barbuda que no haya pronunciado el nombre de Jehova que tire la primera piedra

PS: Homenaje a LUA, y su amor a Brian

Que suelten a Barrabas (o a Bdabas), hombre ya… :P

Mientras tanto, parece que la IA va haciendo amigos…

La nueva tecnología de generación de imágenes es una basura a todos los niveles, pero eso no ha evitado que los mismos “visionarios” que abrazaron en su día las cryptos y los NFT abracen ahora este enésimo intento desesperado de parecer cool sin tener ningún talento creativo ni esforzarse por lo menos en adquirir la técnica para fingir uno. Y no. Escribir sustantivos y adjetivos separados por puntos (lo que denominan “prompts”) no es ingeniería de alto nivel. Es estar alfabetizado en su nivel más básico y un poquito vergonzante.

Protesta masiva de artistas después de que ArtStation promocionara imágenes generadas mediante IA

Cosas de «lamers»… :P

¿Qué hará gran parte de la humanidad sin trabajo?

¿Cómo seguirá fluyendo el dinero?

Harari ya planteaba estas preguntas en el 2015 en Homo Deus. Parecía lejano pero ahora lo vemos a la vuelta de la esquina. ¿Dejará el homo sapiens de ser la especie dominante? Lo vemos en el momento en el que dejamos a un algoritmo tomar una decisión por nosotros asumiendo que lo hará mejor, ya sea trivial como eligiendo el mejor camino para llegar a casa o trascendental como elegir nuestra pareja. Esto está sucediendo ya.

Gran artículo, como de costumbre. ChatGPT no solo va a significar un quebradero de cabeza para profesores que pidan redacciones o ensayos, para profesores de informática como es mi caso, el problema se agrava, porque esta inteligencia artificial es capaz de generar código fuente. Ayer le dije literalmente «¿me puedes decir como cargar un array en lenguaje PHP con los nombre de los siete enanitos?». Y para mi sorpresa me generó el código perfectamente legible y preformateado en la típica ventana de código, separándolo del resto de nuestra conversación. No quise ponerlo más a prueba… ojos que no ven, corazón que no siente… :)

A mi me prohibían utilizar una calculador digital. Lo tenia que hace con regla de cálculo. Premian lo que el circo, «Más difícil todavía», si encuentras una forma de hacerlo mejor y mas rápido, no eres el mas listo, sino un sinvergüenza.

La siguiente generación. se asombrara que ahora no dejen que busques en Wikipedia la respuesta a la pregunta que te pusieron en clase, como a mi me asombra que me obligaran a aprender a escribir, con palillero, plumín y tintero, y que luego no admitieran el bolígrafo y que hubiera que hacer de estranjis, el grabar una clase de la universidad en un casette.

El sistema educativo siempre va muchos pasos por detrás. Es su naturaleza.

Eso me temo, En un mundo tan cambiante como el actual, te educan para vivir en una sociedad que no existe.

Cuando veo a mi nieta aprender inglés con tanto esfuerzo, dedicación, tiempo y dinero y veo los traductores simultáneos que ya existen en el mercado, me pregunto ¿Tiene sentido hacerlo?,

Entonces tampoco hace falta estudiar, prácticamente toda la información ya esta en internet. La sociedad solemos salir de la pantalla y nos gusta relacionarnos, mejorar nuestra capacidad cerebral, hablarnos cara a cara, desarrollar capacidad crítica,…

Lo importante es saber qué necesitas conocer, saber encontrar las respuestas y entenderlas..

A ver. Como persona familiarizada y que trabaja con esta tecnología desde hace tiempo, coincido con lo que dicen otros ingenieros y expertos en el área, como Gary Markus.

Se ha puesto de moda como cada pocos meses saltan a los medios otras tecnologías, pero es un chatbot bastante limitado y con carencias my importantes.

Este veterano de la inteligencia artificial explica por qué ChatGPT es «peligrosamente estúpido»

De hecho, se están poniendo de manifiesto esas carencias con bastante rapidez, porque se inventa los datos, además de los textos, y su comprensión de los mensajes aparte de la corrección semántica, es nula.

¡Se lo inventa!

No entiende ni una palabra de lo que está hablando y es un perpetrador de pastiches virtualmente inagotable.

Para alguien que le resulta una novedad y el primer chatbot que ve, pues claro, le parece asombroso.

Pero para las personas que tenemos un recorrido en estas tecnologías, lo único que nos sorprende es el hype que se está creando en los medios, como con Alpha Go hace unos años. O Libra-Diem, la criptomoneda de Facebook. Se esfuman en poco tiempo.

Afortunadamente, el Machine Learning no está limitado al show tech, pero requiere un juicio muy fino para su aplicación práctica, aparte de su momento de hype, como fue el del big data o el cloud hace unos años.

Ya existen identificadores de textos generados automáticamente, y no es necesario utilizar cosas como una marca de agua, que tiene escasa utilidad.

–

Oh maestro,

Si un apostol como Santo Tomás dudó de un judio hecho una piltrafa y agujereado, quien soy yo para creer sin ver…

Por favor nos puedes copiar enlaces que nos saquen de la ignorancia supina

«Para alguien que le resulta una novedad y el primer chatbot que ve, pues claro, le parece asombroso»

De chats en español, en plataforma abierta a coste cero, para comparar… y que sean mejores claro

Luego continuamos si te apetece la charla técnica sobre esta beta, claros y oscuros

¡Se lo inventa!

Desgraciadamente lo único que por ahora no hace un IA, es inventar.

Lo que si puede pasar es que copie lo que otro se inventó, Como dice Einstein, «Los científicos avanzamos gracias a la imaginación de quienes nos precedieron»

PD

Cita inventada, por si alguno no pesca mis rasgos de humor

Pásese por el canal dot CSV o lea libros de KAI-FU LE para que se ponga al día en machine learning, porque me da que se quedó usted en el pasado. No es sólo CHATGPT, es Doll-e 2, es Stable Difusion , es LaMDA, es Wudao, y lo que está por venir.

Los propios creadores y hasta el mismo chatGPT te cuentan sus limitaciones, comete errores y se inventa algunas cosas, pero eso no le resta importancia a lo que es capaz de hacer y lo que será capaz de hacer en futuras versiones. El salto de GTP2 a GTP3 fue brutal y en poco más de un año.

El hype creado es insignificante, con lo que debería ser, el mundo ya no será nunca igual.

Alguien le ha puesto el castizo nombre de Chatina, en homenaje a Arturo Fernández supongo. Calculo que no son pocos los hombres solitarios que buscan conversación, mientras les sujetan el cubata en la barra.

Otras que se quedaran sin trabajo, Las camareras de los bares de alterne.

«Si majo, tienes toda la razón., Eres muy listo, ¿Me invitas a otro güisqui… ?. Ponme el vaso en el brazo mecánico».

….me has hecho largar una carcajada… Gracias

¡¡¡Qué poco dura la alegría en la casa del pobre!!! – Seguro que cuando lo arreglen pretenden cobrar.

Lo más difícil, en las próximas semanas, va a ser no escribir sobre ChatGPT y algoritmos similares.

Lo más difícil, en las próximas semanas, va a ser escribir sobre ChatGPT y algoritmos similares, sin ayuda del ChatGPT.

Seguro que notaremos un bajón en la calidad de los artículos …. y de algún comentarista

¡¡OHHHH!!

PS: Mis comentarios son siempre de esa guisa, así que me libro de empeorar XDDDD

Lleva días dando mensajes similares. Por otro lado lógicos ya que es una beta. Por otro lado es la primera vez que han puesto un anti bots en la entrada, para verificar que es una persona quien entra y no el típico listo que por ejemplo lo utiliza para hacer un libro de filosofía

Yo si fuera los de OpenAI me molestaria bastante que el género humano sea tan predecible y mentiroso. Ojo que ellos son humanos y están sujetos también a la paradoja de Epiménides

Para los profesores que desde aqui les huelen los pantalones…. hijos la solución es fácil, sed más listos que el robotijo. Y el que no sepa… seguro que os llenáis las clases de tramposos que les encanta la vida fácil. Tenéis el futuro a rebosar. Si es así buena cria de ganaado ovino.

Desde luego que se le puede poner peros y que no es perfecto, pero el salto que ha dado ha sido inmenso.

Imaginad dentro de 5, 10 años……… si la mejoría es exponencial, pasaremos a estar inmersos en un problema.

Seguramente sean los años, pero toda estas nuevas tecnologías a la vez que me fascinan, me dan miedo. Y no por la tecnología en si, si no por que las usamos los humanos y es como darle dos pistolas a un mono.

es como darle dos pistolas a un mono

Y por que no , «como dar a un mono educación primaria»

Porque hasta ahora la mayoría de los monos siempre buscan la peor manera de utilizar las pistolas, menos mal que hay un porcentaje (aunque menor) que actúa de manera constructiva.

Seguro que alguien ya ha puesto un sintetizador de voz y una raspberry en una muñeca erótica y a forrarse….

También el mismo brazo que le pone el guisqui le puede dar conversación ?

jajja

Al igual que un martillo, la tecnología nos brinda herramientas que en nuestras manos se destinan para crear grandes cosas que por otros medio seria mas difícil hacerlo, en lo personal como desarrollador lo alcance a usar antes que fallaran los servidores, entiendo que debido a la inmensa demanda a nivel mundial han colapsado, los desarrolladores no creyeron tener un alcance ni aceptación tan grande como la que han tenido, espero que pronto se pueda restablecer y optimizar el servicio ya que nos ayudaría a dar un salto en la evolución tecnológica y del desarrollo de software

Ninguno existís, todos estos comentarios los publica ChatGPT cuando esté caído… Incluso éste mismo.

¡¡¡ Pero tu no sabes que todos somos becarios de IE, bajo el mando de Capitán Patata !!!

Ains que el metaverso pierde cuerda y como ya se ha recogido la cosecha, hay que sacar la nueva molonidad…

Veremos dentro de cuatro a seis meses donde estará y en que lugares se hablará de esta nueva moda tecnomante. Fácil, dejando sitio a la siguiente.

Y yo me pregunto, ¿si estamos más o menos de acuerdo que la mayoría de todo lo que circula por ahí es ruidera y bajeza acorde al nivel del personal? ¿Qué calidad nos espera de esta bonita caja de resonancia, que vomita refritos de aquello de lo que es alimentada, realimentada y requetealimentada por mediocridades, sesgos, y todo tipo de ejemplos del maravilloso ser humano actual.

¿De verdad el futuro del periodismo, la literatura, la enseñanza, el arte está en manos de esto?

Bonita endogamia nos espera. Los Borbones deben estar encantados.

Tecno(a)mantes como los que no ven necesario aprender inglés porque ya hay traductores muy buenos. La tecnología primero, las personas después… tal vez.

Pues la verdad es que las respuestas son más educadas que las de muchos haters. Algunas veces hasta roza lo empalagoso.

El otro día pude dedicarle un rato a probar ChatGPT y me pareció una herramienta muy interesante.

Hice pruebas variadas, y aunque sus respuestas no son perfectas son lo bastante buenas como para resultar muy útil. Por ejemplo sobre lenguajes de desarrollo daba respuestas útiles pero que yo podría mejorar buscando en documentación o internet durante quizás 5-10 minutos. Pero las daba en 5-10 segundos, lo que representa un ahorro de tiempo al menos igual o quizás superior al que supuso la aparición del buscador de Google, por ejemplo.

Ya se me han ocurrido unas cuantas posibilidades para utilizar la API que ofrece.

Quizá el razonamiento sea diferente, el problema no es hacer deberes con ChatGPT o no, o diferenciar con una marca de agua si el contenido es humano o máquina, es muy díficil detectar esto, si acaso tiene sentido a estas alturas; Si no si hace falta hacer deberes en un entorno en el que todo ha cambiado ya.

¿Cómo se tiene que reinventar la educación con estas herramientas? ¿Qué sentido tendrá estudiar carreras largas de 4 años acumulando conocimiento y haciendo exámenes basados en memorización en lugar de razonamiento? ¿Qué sentido tendrá pagar a alguien por usar un software como Autocad en el que ha invertido años de práctica? ¿Cómo trabajaremos la profesiones basadas en conocimiento e información? El concepto de trabajo, lo vamos a reinventar desde la raiz, va a cambiar radicalmente, vamos lo del teletrabajo del Covid, va a ser una bromita, con lo que viene.

El cambio que introduce text-da-vinci 003 (ChatGPT), no es que genere textos tremendamente buenos que nos ayuden a todas nuestras tareas, las creativas y las no creativas. El cambio está en que se baja la barrera de entrada, cualquiera sin conocimientos, ni estudios previos puede crear con IA generativa, un estudiante que haya entrado en Ingenieria Informática este año con 18 años, estará flipando, verá el temario y dirá ¿dónde está Copilot? Entonces más que aprender un lenguage de programación u otro, deberá aprender a solucionar problemas complejos con un AIsistente que ya va a estar a su lado toda su vida como estudiante y como trabajador.

En mi caso personal, hicimos pruebas de todo tipo con un exitazo tremendo.

Seguramente con el paso de las semanas, no meses, ya podremos ver adelantos enormes en su aprendizaje y en los resultados entregados. Esperemos que pronto pueda volver a estar disponible, veremos si Google no la compra y la cierra, es un competidor duro.

¿Será capaz chatGPT capaz de crear tan buenos clickbait tan como el de este post?

Y levantarse…

Reconozco que esta publicación de Enrique merece la pena. Y el debate que genera

El problema de Google es que aunque tengan el mejor bot conversacional, hacerlo público se cargaría adwords que es su negocio principal, dado que Google manda tráfico a webs, no contesta preguntas directamente.

Google lo sacará cuando aparte de contestar preguntas pueda completar acciones y el bot sea capaz de hacer una compra en amazón o un reserva en airbnb, no diciéndole explícitamente que lo haga, sino que sea capaz de organizarte un viaje al completo o ayudarte a decidir las compras de navidad.

Solo en ese momento podrían sacarlo sin inmolarse en el proceso.

Hola Enrique en tú articulo escribes «hay aplicaciones infinitamente más interesantes y que han generado mucho más valor»

Podrías decir cuales son o cuales crees que generan más valor, se que hay muchas algunas de pago otras privadas y la mayoría las desconocemos al no tener campañas de publicidad por detrás.

Saludos