En un artículo anterior, defendí que los grandes modelos de lenguaje no son arquitectura empresarial. El feedback y las respuestas que recibí fueron claras: ese argumento es difícil de rebatir. La pregunta más difícil es qué viene después: o sea, «si no es esto, entonces ¿qué?»

Es la pregunta correcta. Porque el problema nunca fue que la inteligencia artificial no funcionara. Funciona, claramente. El problema es que intentamos colocarla en la capa equivocada.

Fallamos al decidir dónde poner la inteligencia artificial

Durante los dos últimos años, las empresas han invertido decenas de miles de millones en inteligencia artificial generativa. El resultado no es ambigüedad. Es claridad. Un cuerpo creciente de investigación, incluyendo un estudio del MIT ampliamente citado, muestra que alrededor del 95% de las iniciativas empresariales de inteligencia artificial generativa no logran producir un impacto de negocio medible, a pesar de una adopción muy extendida.

No es porque los modelos no funcionen: es porque fueron insertados en las organizaciones como herramientas, no como sistemas. Intentamos atornillar inteligencia a los flujos de trabajo, cuando lo que necesitamos son sistemas en los que la inteligencia sea el flujo de trabajo.

De herramientas sin estado a sistemas persistentes

Los grandes modelos de lenguaje son, por diseño, sistemas sin estado: cada interacción empieza desde cero salvo que reconstruyamos artificialmente el contexto. Las empresas son lo contrario. Son sistemas con estado: acumulan decisiones, siguen relaciones, evolucionan en el tiempo y dependen de la continuidad.

Este desajuste no es una incomodidad menor. Es estructural. La investigación sobre fracasos de inteligencia artificial empresarial apunta de forma consistente al mismo problema: los sistemas no fallan porque generen malas respuestas, sino porque no pueden integrarse en procesos continuos ni mantener contexto a lo largo del tiempo.

La inteligencia artificial empresarial no puede estar basada en sesiones. Tiene que recordar.

De respuestas a resultados

Optimizamos la inteligencia artificial para responder preguntas. Pero las empresas necesitan sistemas que cambien resultados. Aquí es donde la brecha se vuelve evidente: un LLM puede generar una estrategia comercial convincente, pero no puede seguir si funcionó, adaptarse en función de los resultados, coordinar la ejecución entre equipos ni mejorar con el tiempo.

Eso no es una limitación de implementación: es una limitación de diseño.

La misma investigación del MIT describe una “brecha GenAI”: organizaciones atrapadas en una alta adopción pero baja transformación, precisamente porque los sistemas actuales no cierran el bucle entre acción y resultado.

Las respuestas no cambian las empresas. Los sistemas sí.

De prompts a restricciones

Buena parte de la conversación actual sobre IA gira en torno a los prompts. Pero los prompts son solo una interfaz. Las empresas no operan mediante prompts: operan mediante restricciones, reglas de cumplimiento, permisos, umbrales de riesgo y límites operativos.

Y ahí es donde se rompen la mayoría de los sistemas de inteligencia artificial. Generan dentro de probabilidades. Las empresas operan dentro de restricciones.

Esta es una de las razones menos discutidas y más importantes por las que las iniciativas de inteligencia artificial empresarial se atascan. Incluso la investigación más amplia en inteligencia artificial muestra que los proyectos fallan cuando los sistemas no están alineados con restricciones reales, flujos de trabajo y contextos de decisión.

Los prompts son UX. Las restricciones son arquitectura.

De copilots a sistemas de acción

La metáfora dominante de los dos últimos años ha sido la del «copilot». Suena atractiva, pero también es engañosa. Un copiloto sólo sugiere, una empresa necesita sistemas que actúen. La diferencia importa, porque sugerir es barato, pero ejecutar es difícil.

La ejecución exige

- Integración con sistemas de registro

- Coordinación entre procesos

- Responsabilidad sobre los resultados

- Adaptación en el tiempo.

Y ahí es precisamente donde colapsan la mayoría de los enfoques actuales. No porque estén mal implementados, sino porque nunca fueron diseñados para eso.

El cambio de arquitectura del que casi nadie habla

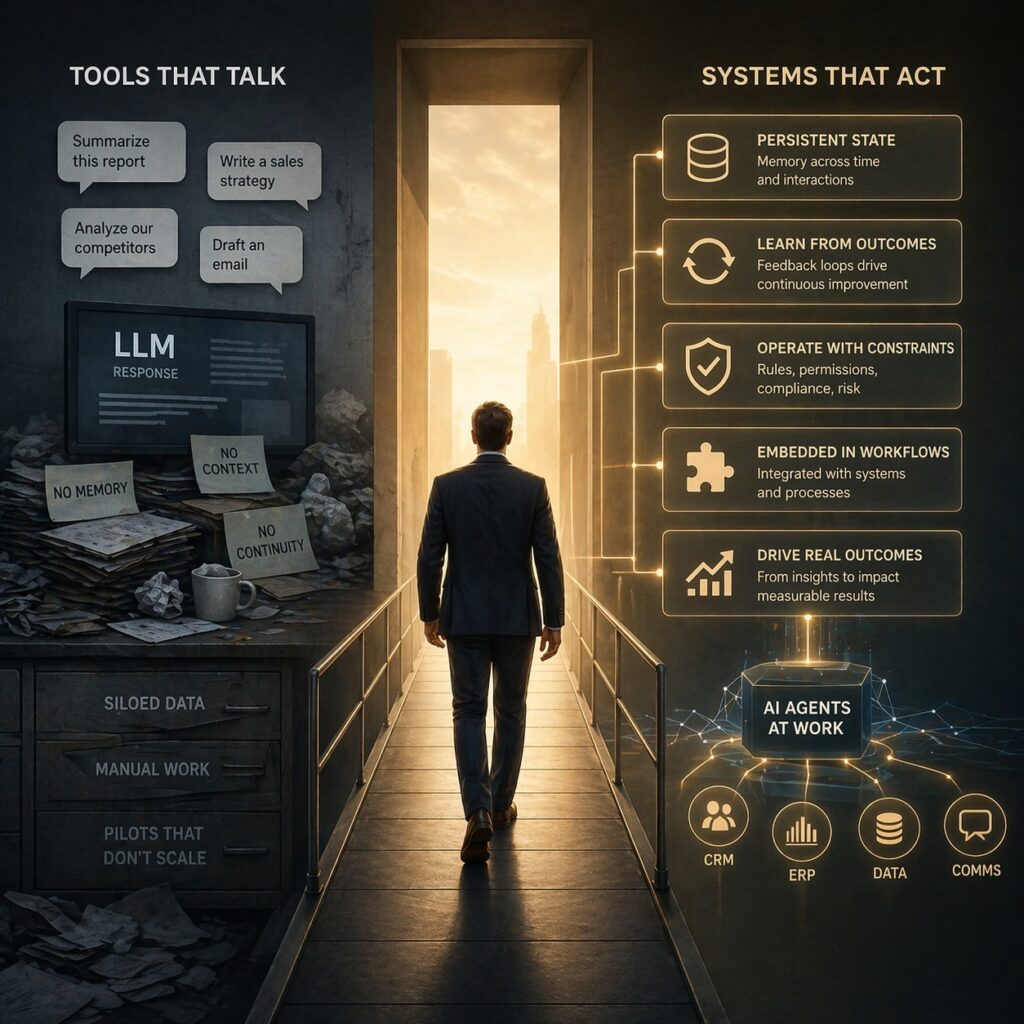

¿Qué sustituye entonces a esto? No mejores prompts, ni modelos más grandes, y desde luego no más infraestructura. La siguiente fase de la inteligencia artificial empresarial estará definida por algo completamente distinto:

Sistemas que combinen:

- Estado persistente

- Flujos de trabajo embebidos

- Aprendizaje continuo a partir de resultados

- Operación bajo restricciones

- Integración con entornos reales.

En otras palabras: sistemas que no solo generen lenguaje sobre el mundo, sino que operen dentro de él.

La investigación y la práctica están convergiendo en la misma conclusión: el éxito no viene de herramientas genéricas, sino de sistemas que se adaptan, aprenden y se integran en los flujos de trabajo.

Por qué este cambio parecerá una discontinuidad

Todavía estamos al principio de esta transición. La mayoría de las organizaciones invierte en la capa visible: modelos, interfaces, infraestructura. Pero el verdadero cambio está ocurriendo una capa más abajo.

Y cuando se haga visible, no parecerá una mejora incremental: parecerá una discontinuidad. Porque no estamos pasando de una «inteligencia artificial peor» a una «inteligencia artificial mejor». Estamos pasando de herramientas que hablan a sistemas que actúan.

La verdadera oportunidad

Esto no es el final de la inteligencia artificial empresarial: es el final de un malentendido. Los modelos de lenguaje por sí solos no son arquitectura empresarial, son una capa de interfaz. Una muy potente, pero completamente insuficiente por sí sola.

Las empresas que lo entiendan primero no solo desplegarán mejor la inteligencia artificial. Construirán algo que sus competidores no reconocerán… hasta que sea demasiado tarde.

(This article was previously published on Fast Company)

Un problema parecido se dio con la adopción del PC: no basta con llevarlo a una oficina y escribir los documentos con el procesador de textos para que la mejora de productividad sea visible. Incluso puede ser contraproducente.

Si no adaptas toda la ‘cadena de producción’ a la nueva tecnología, lo que no se ha actualizado seguirá siendo el cuello de botella. Siguiendo con el ejemplo de la oficina, necesitas digitalizarlo todo (la documentación, la gestión, la producción, las comunicaciones…) para que la mejora de productividad global se note.

Con la IA ocurre lo mismo: puede aumentar la productividad de un programador por ejemplo pero todos los demás componentes que no integren lo que la IA aporta serán los cuellos de botella que impidan ver una mejora en la productividad global de la empresa.

«sugerir es barato, pero ejecutar es difícil» (EDans).

Una frase para enmarcar. Y no solo en despachos empresariales, sino en las cuevas donde se juntan las vanguardias que se dicen revolucionarias.

También vale como «programar es fácil, lo difícil es ejecutar el programa». Para la entrada en la sede de cualquier partido político.

OffTopic:

Te dejo una, Xaquin, que te va a encantar…

Reunión de tutoría.

Martes.

17 : 10.

Aula de primaria.

Sillas pequeñas.

Pósters de planetas.

Y un profesor con cara de llevar 9 meses tragando cemento emocional.

Entran los padres de Hugo.

9 años.

Suspendido en lengua.

No entrega deberes.

Interrumpe en clase.

Ha llamado “NPC” a la profesora de música.

La madre deja el bolso en la mesa.

—Venimos preocupados.

El profesor asiente.

—Yo también.

—Hugo está desmotivadísimo.

—No estudia.

—Porque no le motiváis.

Ah.

Claro.

El niño no lee, no escribe, no atiende y no trae la libreta.

Pero el problema es que el profesor no ha convertido los adjetivos en una experiencia inmersiva con luces LED.

El padre se cruza de brazos.

—En casa es muy inteligente.

—No lo dudo.

—Entonces, ¿por qué suspende?

El profesor abre el cuaderno.

—Porque en el examen dejó 7 preguntas en blanco.

La madre frunce el ceño.

—¿Y no se las podías adaptar?

Adaptar.

La palabra mágica.

Antes significaba ayudar a quien lo necesitaba.

Ahora significa que mi hijo no se frustre aunque no haga nada.

El profesor respira.

—Hugo puede aprobar. Pero tiene que trabajar un poco.

La madre se ofende.

—No queremos que pierda la autoestima.

Autoestima.

Otro comodín.

Como si corregir a un niño fuera romperle el alma.

Como si decirle “esto está mal” fuera violencia institucional.

Entonces el padre suelta la frase:

—Igual el problema es que no sabéis conectar con esta generación.

El profesor mira por la ventana.

En el patio, Hugo está intentando meterle tierra en la mochila a otro niño.

Conexión generacional.

Precioso.

Al día siguiente, correo a dirección:

“Estamos muy decepcionados. Sentimos que el colegio no acompaña emocionalmente a nuestro hijo.”

Acompañar emocionalmente.

Traducción:

“Mi hijo no hace nada, pero quiero que parezca culpa vuestra.”

Y ahí está el problema.

No son los niños.

Los niños prueban límites.

El problema son padres que llegan al colegio no para escuchar, sino para defender un expediente.

Padres que confunden educar con proteger del esfuerzo.

Padres que quieren profesores suaves, notas altas y cero consecuencias.

Resumen:

Si tu hijo suspende, puede necesitar ayuda.

Puede necesitar apoyo.

Puede necesitar otra forma de aprender.

Pero también puede necesitar algo mucho más revolucionario:

Que en casa alguien le diga la verdad.

Espero que los doctos empresarios de medio pelo, se hayan enterado de algo…

Lo que vivimos ante los LLM es una ilusión (una puta ilusión), ni son listos, ni son inteligentes, ni aprenden.

Una vez que has cerrado el entrenamiento de uno de ellos lo que tienen en su su sesera, es lo que tienen. Básicamente te va a correlar una serie de tokens para darte respuestas. En este caso la cantidad hace cierta calidad, eso es indudable, pero eso no hace más que llevar el limite de su calidad a otra cota superior.

Le puedes llamar galgo o podenco, pero las instrucciones son instrucciones. Si los prompts no dejan de ser otra cosa que restricciones, ordenes, flujos donde indicarles como actuar. No hay LLM que acepten una cosa o la otra. lo que habrá serán prompts más o menos elaborados. Y habrá prompts que se los metas a fuego (fine tuning) pero que no dejan de ser lo mismo… Pero, no te preocupes que si a qwen le podemos hacer hablar de Tianamen tras 100 intercenciones a propósito, cualquier LLM cantará La Traviata si es eso lo que le obligamos. Como diría Blake Lemoine, no tortures al mierda del chiquillo… que es un LLM con su coranzoncito !!!

Cuando quieras convertir un LLM medio bobo en «un sistema de acción» la clave no está en la IA, sino en el trabajo de un buen integrador que lo maneje y le obligue a ser «accountable» ( a parecerlo), cosa que nunca será, pero el integrador jurará por sus niños, que su sistema es la bomba, que se lo digan a Palantir, si luego se fulmina el departamento X, o un colegio de crias, que más da, si son daños colaterales…

¿pero entonces si la estrategia empresarial es dejar al medio bobo del LLM la acción para que se necesitan «directivos» que a la primera de cambio, dirán ha sido la IA, ha sido la IA, yo no, yo no… ha pensado que eráis prescindibles… ??? No pedazo de allcornoques empresariales…

LA RESPONSABILIDAD NO SE DELEGA,

siempre será vuestra, pedazo de inútiles 2.0

Todavía estamos a tiempo de no hacer gilipolleces con las IAs. No se delegan las responsabilidades. Leed bien el artículo de Enrique: habla de aprovecharse en las empresas de incluir IA en los procesos o flujos pero siempre bajo el control humano. No seamos como los Palantir !!!

Que la IA ejecute siguiendo las reglas y respetando a rajatabla las restricciones que le defina un humano. Es así de simple

El ALINEAMIENTO.

Ya lo dijo el maestro Asimov, el problema es que las IAs siguen las reglas, pero a su manera. También a su rajatabla:

– La interpretación literal vs la intención.

– ¿Qué es dañar, qué es inacción?

Es muy difícil dar esas reglas estrictas que se adapten a todas las situaciones.

Noticia de hoy mismo: OpenAI Deployment Company

Buen diagnóstico, Enrique. En marketing se ve clarísimo: la mayoría de las empresas están usando IA para generar (copies, creatividades, posts) cuando lo que necesitan es IA que aprenda del resultado de cada impacto y ajuste el siguiente.

Producir contenido es barato. Cerrar el bucle entre campaña, conversión y aprendizaje real es donde está el valor, y ahí es donde casi nadie está trabajando. Seguimos midiendo prompts cuando deberíamos estar diseñando sistemas que recuerden al cliente, entiendan el contexto y operen dentro de las restricciones de marca y presupuesto.

La discontinuidad va a ser silenciosa: en dos o tres años habrá marcas cuyo marketing sea un sistema que se optimiza solo, y otras que seguirán pidiéndole a ChatGPT diez variantes de un anuncio. La diferencia no será de eficiencia, será de categoría.

Vi allí, que una razón o causa de eso es la visión operativa neta y divorcio fuerte de lo estrategico, inyectando IA como si fuera un antibiotico. Se requiere una visión estrategica para introducir la IA , para luego medir su grado de contribución en las metas y objetivos.

Creo que esto lo explica muy bien el libro «IA autonoma y sistemas multiagentes»: de preguntar a ejecutar

Debería estar un poco más actualizado en investigación avanzada de IA, no la que venden comercialmente. Hay una diferencia grande en cuanto memoria, aprendizaje autónomo y recursividad.