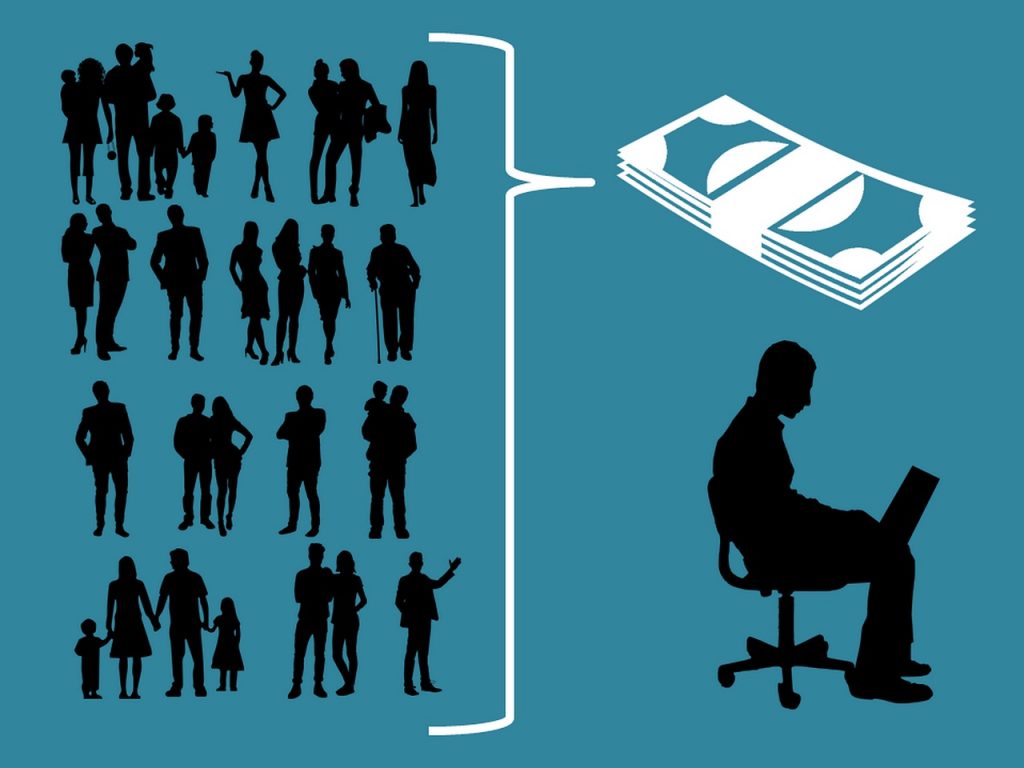

Es un tema que llevo viendo evolucionar ya bastantes años: el uso de algoritmos de machine learning para tomar decisiones de inversión. Y en el caso de los capitalistas de riesgo, además, la cuestión tiene todo el sentido del mundo: hablamos de compañías que llevan ya años invirtiendo en compañías dedicadas al machine learning, por lo que tratar de utilizar y aplicar sus productos precisamente en su propia actividad, una vez que has estudiado su funcionamiento, resulta más que razonable.

¿Qué es, después de todo, una decisión de inversión en una startup? Básicamente, el fruto de un conjunto de análisis y de experiencias anteriores. Los análisis de la compañía provienen de una toma de datos que puede sistematizarse y verificarse de múltiples maneras, mientras la experiencia corresponde, en realidad, a la cristalización imperfecta, con sus sesgos y errores, de una serie de decisiones anteriores, ponderadas por el resultados que se obtuvieron en cada una de ellas.

Obviamente, un inversor de capital riesgo no suele ser objetivo: habitualmente, permite que entren en su proceso de toma de decisiones múltiples factores, desde las sensaciones que le genera el equipo fundacional de la compañía, hasta análisis más o menos rigurosos de su capacidad de desarrollo futuro.

¿Podemos plantearnos sustituir o complementar este tipo de decisiones, en muchos casos personales o consensuadas entre los miembros de un fondo de inversión, por los resultados de un análisis algorítmico que utilice como entradas las decisiones tomadas anteriormente, etiquetadas con los resultados que obtuvieron al cabo del tiempo? ¿Puede el éxito de una startup predecirse, o depende en muchos casos de conjunciones de factores imposibles de prever o cuyos resultados pueden ser diferentes en cada momento, con casuísticas que dependen de factores personales o coyunturales específicos? ¿Qué ocurre cuando el éxito, además, está influenciado de manera significativa por las sinergias o los contactos que los inversores pueden aportar al proyecto de la compañía?

Hace algunos años, impartí una sesión que se titulaba algo así como «Cuando un algoritmo decide si te conceden la hipoteca». Cada vez más, hay decisiones con trascendencia económica de este tipo sustentadas por procesos analíticos de este tipo, con todo lo que ello conlleva. Posiblemente haya factores como la intuición y la experiencia que no desaparezcan nunca, pero que cada vez más, comiencen a estar cada vez más influenciados por lo que un algoritmo determinado, sustentado por muchísimos datos de rondas de inversión previas y de sus resultados a lo largo del tiempo, obtenga en sus predicciones.

Como tal, un algoritmo no es un ente abstracto, sino un constructo analítico basado en matemática y estadística, obtenido a partir de unos datos determinados, y etiquetados con el resultado que esos datos produjeron. Obviamente, nada garantiza que no estemos dejando fuera del análisis variables que fueron muy relevantes en el resultado final y que simplemente no hayamos sabido entender o recoger, pero podemos aproximar qué parte de la decisión es susceptible de ser explicada mediante nuestro análisis. Tampoco asegura que no existan sesgos, dado que estos sesgos pueden venir determinados por los datos con los que alimentamos o educamos al algoritmo.

En realidad, no decide un algoritmo, ni una máquina: deciden los casos precedentes que puedan asemejarse más o menos al nuestro. Y en el futuro, el análisis de esos casos precedentes podrá decidir muchas cosas: desde si nos conceden un crédito o si financian nuestro proyecto, hasta si nos admiten en una universidad determinada. Vete preparándote.

This article was also published in English on Forbes, «How do you feel about an algorithm deciding if your startup gets funding?«

Procuro no ser mal pensado, pero creer que un algoritmo es el que ha decidido «ayudar» a Plus Ultra, es más que lo que puedo digerir,

Quizá el interrogante sea si el futuro se puede prever sólo en función del análisis del pasado.

¿Éxitos y fracasos pasados son suficientes para augurar los futuros? ¿Habría el algoritmo invertido en todos los casos de éxito que hoy conocemos, con los datos que tenía en ese momento?

Es indudable el valor que puede aportar al análisis de variables con machine learning y a «templar» con ello la posible subjetividad de los expertos, pero me pregunto si darle demasiado peso a los resultados automatizados podría ser pernicioso para lo a menudo sorprendente e incluso absurdamente genial de la creatividad humana -incluida la empresarial-.

En definitiva se trata de tener un dataset apropiado en el que vas a apoyar tu análisis, basado en experiencias previas como muy bien dice Andreu

El algoritmo para clasificar oportunidades de startup es menos complejo que clasificar un dataset de imágenes de animalitos y que el resultado te diga que es un gatito o un perrito…

Si al directivo que alardea de realizar su decisión con un «engine powered IA» le viéramos como el que te dice para saber que mascota es gato/perro el animal de una foto. Entonces su decisión se podría comparar de menos de la del preescolar más torpe de una clase de parvulario,

Sinceramente, ese es el nivel que nos movemos con la IA, y el mercado persa que se mueve alrededor.

Soy un convencido de la ayuda en la decisión de la IA, pero en este caso tengo alguna duda con respecto a la analítica. Podria haber sesgos y sobretodo falta de datos.

Yo me fio mucho del fundador, y esto es difícil de analizar.

O haciendo autocrítica. En enero levante una ronda básicamente x confianza de los inversores en mi vision y sin embargo, esta podria cambiar, de hecho, no la tengo del todo clara y no sabria como trasladarla a datos de para el algoritmo.

Es interesante como la inteligencia artificial influenciará en la toma de decisiones de inversiones. Mi duda es si al igual que en Google las empresas utilizan técnicas de SEO para ganar posiciones en el ranking, si las startups harán algo parecido, tomando los datos de las inversiones por parte de las VCs a la hora de mostrar sus propios datos o elegir estrategias.

A día de hoy, tanto VCs como Startups usan datos de la otra parte para evaluar potenciales inversiones como inversionistas. Ese tipo de IA también será utilizada por las Startups aunque probablemente no sea in-house, como la de muchos de estos VCs.

Caso a)

Empresa, automatizacion oficinas, dealers de HP y Panasonic, que factura alrededor de 1000mill anuales (pesetas, eh?) levanta ronda con inversores privados y en dos años, al cierre…

Caso b)

Empresa, creada por constructores. Empiezan a ver que lo de nuevas tecnologias puede ser un «pelotazo» (si, pelotazo). Crean un grupo de franquicias, productos a traves de Ibertext, sacan sus buenos dineros y a dia de hoy, aun en pleitos con inversores despues de 20 años…

Caso c)

Empresa familiar, fundada en 1945. Mobiliario e interiorismo. Tres hermanos al frente de tres empresas (matriz y dos filiales). Volumen de facturacion cercano a los 6000mill. Un dia, deciden que ya esta bien de trabajar, que a jubularse que ya toca. Cierto que echan a todo dios a la calle, no solo con lo que les toca por ley, sino con sustancioso «complemento», despues de un año de haber levantado financiacion privada…

Podria una IA, haber previsto estros tres casos reales (vividos por mi) ???

Aquí nadie habla de predecir el futuro con precisión. Las empresas inversoras usan herramientas para recolectar datos de las Startups y los analizan para decidir si invertir en ellas o no, es algo muy común y útil. La IA les ayuda a hacer ese análisis mejor y una predicción de su rentabilidad más fiable pero no infalible.

En eso estamos de acuerdo, Carlos…

Pero es que eDans, a veces, nos habla de algunas cosas (sobretodo con IA) como si fuera el Oraculo de Delfos… :)

Hay que ser mas realista…

Que puedes alimentar una IA con un millon de radiografias y a partir de eso, «deducir» que una determinada, puede ser un cancer de pulmon? Estoy de acuerdo…

Pero para otros menesteres, ni tanto, ni tan preciso…

Y para aclarar… yo no estoy en contra. Soy realista. Algo que a muchos les hace falta una dosis… XDDD

Cuando hay que darle una colleja a Enrique, tú y yo se la hemos envíado por comentario.

En este caso el artículo, lo he releido, no me parece que se tire a piscinas místicas, está siendo muy realista. El último párrafo es crudo muchos «payasetes de la IA» van a usar lo que les diga un score de una salida de un algoritmo sin tener ni puta idea de su negocio, pues si,

El otro día me decía Enrique en un comentario que un determinado lenguaje de programación era complicado. Y podíamos pensar entonces que los gestores de empresas van a usar unos wizard, que no van a tener ni puta idea de los algoritmos y lo que están haciendo pero se van a fiar de esas salidas. ¿Cómo sabemos que los algoritmos que usen no estén sobreajustados?¿ O que no hayan filtrado adecuadamente los casos anómalos, los casos erróneos, parciales,…?¿Habrán hecho un abuena regularización/normalización?

Los datasets deberían ser transparentes y públicos para poder detectar si realmente funcionan como dicen que funcionan… Usas ML, pues entonces hace falta una LEGISLACION PARA PERMITIR SU USO…

De hecho yo prohibiría que usaran algoritmos para decisiones que afecten negativamente a las personas (préstamos, admisiones, etc) y que se pudieran solo aplicar como ayuda a pre-diagnósticos, detectar spam, mandarte publicidad, y poco más

Precisamente la banca es uno de los sectores que más están cambiando gracias a la tecnología, con empresas con pocos empleados comiéndose el mercado de la banca tradicional y puedes dar por hecho que los préstamos los acabará aprobando o rechazando un algoritmo.

De hecho yo prohibiría que usaran algoritmos para decisiones que afecten negativamente a las personas (préstamos, admisiones, etc) y que se pudieran solo aplicar como ayuda a pre-diagnósticos, detectar spam, mandarte publicidad, y poco más

Exactamente. En algunas cosas habria que poner limites, o no dejar de lado la supervision humana.

Cuando he dicho lo del Oraculo, no ha sido referido a Enrique sino a la IA en si.

Está muy bien la IA y es una buena herramienta de ayuda para la toma de decsiones. Pero a la hora de la verdad, quién tiene que tomar las decisiones es un Ser Humano.

Yo confío mas en la intuición y la experiencia que en la eleccion ciega segun unos fríos datos fuera de contexto.

Va a empezar siendo de ayuda y va a terminar haciéndolo solo y casi todo.

Tu puedes fiarte de un ser humano , pero la empresa quiere resultados.

Cuando la empresa tire de estadística y vea que , por ejemplo, en la concesión de hipotecas, el algoritmo no solo tiene mejor porcentaje de aciertos que el humano, si no que mejora continuamente incorporando los errores para no repetirlos, adios humanos.

Se trata de un problema de «clasificación» que ya se hacíaal comienzo del ML ( no pongo lo de los 50s para no sonrrojar) escoges tu dataset con unas variables de entrada, y la salida es un resultado binario «apto» o no «apto» para financiar. Lo que salga tendrá la precisión que tenga tu datos «de entrenamiento». Recordemos que la ML no es magia, si aplicas ML a una muestra que «muestra» una probabilidad del 85% tendrás como mucho una probabilidad del 85%. (Aunque uses ML a las apuestas deportivas, la probabilidad no será mayor que lo que la teoría probabilística te dé)

¿tenemos ese dataset?

¿Conocemos las variables que usa?

¿El preprocesamiento de los datos se ha hecho correctamente?

¿Han dejado fuera los datos anómalos?

¿Qué score consiguen con el dataset de test?

¿Que algoritmo aplican?

Si no sabemos nada de eso, el opinar si un algoritmo lo hace bien o mal es una GILIPOLLEZ, y me quedo con el último párrafo de Enrique…

Evidentemente se puede usar cualquier ML básico para saber que tipo de lirio es un ejemplar, con un score bastante alto, y el asunto aquí planteado de «¿Damos financiación? se puede hacer de manera trivial con cualquier algoritmo clásico, no parece que hagan falta muchas luces para ello. Cualquiera con un laptop viejo, scikit-learn o weka, o H2O, o si no quieres florituras hasta con el guiaburros de BigML y menos de 30 sg. de entrenamiento lo hace.

No és del todo cierto lo de que empezó en los años 50. Marvin Minski, una de las primeras eminencias en IA, retrasó el uso de los perceptrones casi 40 años pues con una sola capa no podían aprender a solucionar el problema de una puerta lógica XOR. Fue a finales de los 80 cuando una interconexion entre capas y el algoritmo backpropagation demostraron que las redes neuronales artificiales podían solucionar dicho problema. Y de ahí, con decenas de capas o layers con centenares de perceptrones y miles de datos de entrenamiento, en 2010 se llegó al deep Learing, madre de la mayoría de avances en Machine Learning. Y justo cuando se empezaba a acabar la gasolina, aparecen las ANN, o adversarial neural networks, que de forma alucinante aprenden de forma no supervisada sin necesidad de etiquetar los datos….

Para que os hagáis una idea, Alpha Zero (adversarial, autor trenada desde cero sin ningún ejemplo humano)) ganó 100 a 0 a Alpha Go (Deep Learning, entrenada con partidas humanas), que ganó 4 a 1 a Lee Sedol, múltiple campeón mundial de GO, 4 partidas a 1…

ALUCINANTE!

35 M USD tienen la culpa

Te importaria explicarte? No entiendo lo de los 35 millones…

Si no tienes 35M$ no puedes crear un sistema para ganar al campeón de GO.

Lo puse hace poco en una referencia a lo que había costado. Para que te hagas una idea de Alpha Zero

En el fondo del artículo planea el gran temor expresado en repetidas ocasiones por el crack de los crack, Elon Musk. Le tiene más miedo a un sobreuso y descontrol de la IA que al arsenal nuclear mundial.

En el fondo és un debate que la película «war games» (juegos de guerra, uno de mis clásicos favoritos, por cierto),, de 1983, ya ponía sobre la mesa.

Dependerá de nosotros que determinemos hasta dónde un algoritmo, por bueno que sea, decida nuestro devenir con sus decisiones. Y lo de las hipotecas está al caer, han empezado por detectar posibles operaciones bancarias fraudulentas, pero eso solo es el principio…

Actualizando el tema de la película de la que hablas el problema sería que los algoritmos de Defensa de USA y China tomaran el control y se pusieran a competir sin supervisión.

¿Otra partida de ajedrez profesor Falken?

Normal que le tenga más miedo. Ahora estaremos en pañales pero, como dice Harari, igual estamos creando a nuestros dioses.

Me encantaba el profesor Falken! De mayor queria ser como él!. Y el final de la peli, en la que Joshua aprende a partir del… (SPOILERT ALERT) Tic-Tac-Toe es simplemente genial!

Generalizando este tema más allá del capital riesgo, entraríamos en el debate del «Problema del cálculo económico» enunciado por Mises y extendido por Hayek.

¿Podría el Machine Learning hacer viable la planificación económica típica de los modelos socialistas?

Y resucitar a los dinos ?

Si la respuesta es que la IA no hará viable la economía planificada, entonces tampoco podrá predecir si una start-up tendrá éxito.

En ambos casos la tarea a resolver es la misma: predecir el comportamiento humano.

Pregúntese al algoritmo si es rentable invertir en una fabricas de baterías de litio en Badajoz y «aliméntese» con estos datos:

Promotores: Personas (con antecedentes sobre producir baterías que nunca se fabricaron) que dicen que van a producir baterías de litio.

Dinero que va a llegar de la Unión Europea y que hay que presentar proyectos rápido para acapararlos.

Elemento «a fabricar» que es muy complejo (aunque parezca sencillo) porque se pueden contar con los dedos de una mano las empresas del mundo que lo fabrican.

No pueden decir: Esto es lo que he inventado, funciona y ahora voy a fabricarlo, porque no lo tienen.

Ya bien podrían aplicar algoritmos a decisiones políticas que nada tienen que ver con la lógica y fría realidad de los datos y si con los «chanchullos» tan humanos ellos. A eso me apunto…pero va a ser que no.

Cuando una entidad concede un préstamo a un particular o un startup, tiene un proceso interno de aprobación con su consabido análisis de riesgos. Ese proceso se puede seguir con

a) Papel. Respondiendo a una serie de preguntas con las respuestas que un responsable del departamento de marras va rellenando. Y le da un score. Ese score será al final un resultado; «apto» o «no apto». O una escala de 0 a 100, donde cero es el no apto absoluto, y 100 el apto absoluto

b) Sistema Experto. Lo mismo que en papel pero ese «dossier» es recogido en formularios informáticos y un dashboard. Normalmente esa tool es revisable y se puede chequear que el proceso seguido es el mismo que en papel

c) Algoritmo de ML. Hacemos lo mismo que en (b) pero no se sigue el proceso tal cual. Sino que se alimenta con el históricos de variables de entrada del proceso y el resultado salida(labelled) nos sirve para calcular el score de ese modelo basado en algoritmos. Ese resultado variará dependiendo si el modelo utiliza regresión(lineal, polinómica, logística), SVM, Kmeans,… y entonces (asumiendo datos de entrada preprocesados correctamente) entonces tendremos una salida y una probabilidad con el que mejor score nos haya dado en el entrenamiento. En general, se habrá perdido en que se basa el algoritmo para ese resultado, pero si podremos decir que era el que más acierta. Si las variables de entrada están sesgadas la salida está sesgada. Si hay nuevos condicionantes que no se tienen en cuenta el algoritmo estará ciego.

Por ejemplo startup para abrir una fábrica de baterias en una provincia de España. Si el algoritmo tiene datos históricos con sector automovil diesel como éxito, y en su momento fracasaron tres iniciativas de abrir una fábrica de baterias. EL resultado del algoritmo será probablemente para el caso consultado «no apto».

Esa es la realidad de la ML usada en préstamos a statups, y luego podemos hablrar de terminator, pero pongámonos a tierra. Luego eso si habrá implementaciones de ML males, regulares o buenas. Lo mismo que cuando ves «un calculador hecho en excel para negocios», los habrá malos, regulares y buenos…

Y el algoritmo probablemente tendrá que usar «un aprendizaje con refuerzo» e ir actualizando los datos de entrada con un mercado que es dinámico.

El proceso con ML necesitará un grupo que vaya evolucinando, calculando el score de éxitos, etc…

En la bibliografía clásica de ML, se puede consultar ejemplos de recomendación para «predecir exitos musicales». La ML está entrenada con una base de datos de música. Entonces pruebas la canción nueva y te dice el score que tiene. ¿Será un éxito? Eso es otro cantar. Pero la ML siempre te dirá algo respecto al histórico…

Precisamente porque los algoritmos descansan en el cálculo de probabilidades, nunca serán capaces de detectar un cisne negro, por lo que no valen para las cosas importantes.

Un poquito de humildad como la de Nassim Nicholas TALEB.

Las cajas se arruinaron por apostarlo todo al ladrillo.

Y en yanquilandia en vez de ser políticos arruinando cajas de ahorros, fueron «gestores» como de Guindos que arruinaron toda la banca de inversión.

Daban hipotecas a los NINJA y cuando un gestor de riesgos preguntó por que tenía que aceptar todos los prestamos le dijeron que la basura que el firmaba por la mañana la había comprado Wall Street por la tarde.

A veces lo rentable es ser honrado, y otras veces es no serlo…

El problema es que no está de moda el Meiyo y mucho menos el Seppuku. Pero en fin si la yakuza financiera no es Makoto lo de usar con ellos el cuchillo capa cerdos… no debería estar tan mal visto.

El bushido es clave en la cultura de las Keiretsu.

Quizás por eso la economia de Japón es tan aburrida desde hace 30 años.

Les pinchó la burbuja y no han vuelto a levantar la cabeza, ni a hundirla.

La cultura japones me da miedo y admiración a partes iguales. Estoy del lado de los Hikkikomori…

Me parece más divertido ir al distrito de Harajuku y ver las performances cosplay

Enfrentarse a imprevistos es el grave problema de los algoritmos, el ser humano reacciona ante ellos mucho mejor que el algoritmo.

E imprevistos. es algo que se curiosamente, hay que preveer que haya, Hoy es un barco atravesado en el Canal de Suez, y ayer, que nieva en Taxas, y anteayer que se declara una pandemia,

«La vacuna de Pfizer hizo saltar por los aires los algoritmos de los hedge funds en Wall Street »

https://www.eleconomista.es/mercados-cotizaciones/noticias/10891761/11/20/Los-buenos-datos-sobre-vacuna-hacen-saltar-por-los-aires-los-algoritmos-que-mueven-la-bolsa.html

El problema es cuando es la gente la que crea el imprevisto, como la elección de Trump ¡muy imprevisto¡…..y visto ese riesgo dame antes el peor escenario distópico que se te ocurra siempre que mande un algoritmo lo suficientemente inteligente…¡al menos será inteligente!

Tu fe en los algoritmos. conmueve

No quiero ni pensar en las fábricas que ha fiado su producción a los algoritmos «Just on time», ahora que han concidido la escasez de chips y el repraso de suez.

Exactamente.

Leídos artículo y comentarios, me sorprende sobremanera que nadie haya citado el que para mí es el factor clave principal y el que a mi juicio tiene mas peso en la matriz de criterios a considerar: la SUERTE.

No recuerdo de quién es la frase, pero para mí es definitiva: “Vale más una gota de suerte que un océano de información”. Que se lo pregunten a los dinosaurios y al meteorito.

Y después está aquella otra que también tiene lo suyo: “Se trata de estar en el lugar adecuado en el momento adecuado”. Eso explica por qué entre dos propuestas casi idénticas una triunfa y otra no simplemente a causa del momento en que son presentadas e implementadas.

Si se ha hablado, lee a Taleb y su cisne negro

El problema de los hedgefunds es que se fundamentan en el principio neoliberal de que todos somos racionales.

Matizan que no todos somos 100% racionales, pero si los que importan, los que maneja en mercado…

En esto que llegó la crisis de 1998 y el primer Hedge fund, Long Term Capital Management, con los premios nobel neoliberales de asesores, quebró y tuvo que ser rescatado, porque los que «importan», los que «manejaban el mercado», se fueron al oro, el valor refugio, por miedo…

De poco te sirve un algoritmo si no lo fundamentas en principios sólidos.

Nadie me lo ha preguntado, pero expongo mi opinión: La IA actual está basada, tal y como se dice en el articulo, en correlaciones y estadistica de datos. Pero los pioneros de IA trabajaban a partir de reglas lógicas y sistemas de deducción como los sistemas expertos. Creo que la verdadera inteligencia artificial con la que todos pensamos (que seria la IA general o broad AI), frente a la IA especifica (narrow IA), estriba en que la segunda puede hacerse a partir de máquinas de aprendizaje y muchos datos, pero la verdadera IA deberá ser una mezcla. En ese sentido, quien se está dando cuenta y trabaja en ello es un brillante y experimentado cientifico llamado Doug Lenat y su base de datos de sentido comun CYC. Si a alguien le interesa, su web es cyc.com.

Es cierto nadie te lo ha preguntado, pero ya puestos en faena algo que está al 10% después de 37 años… ¿decimos más?

Tal y como comenta Sin Censura en 006 «De hecho yo prohibiría que usaran algoritmos para decisiones que afecten negativamente a las personas (préstamos, admisiones, etc) y que se pudieran solo aplicar como ayuda a pre-diagnósticos, detectar spam, mandarte publicidad, y poco más»

Algunas cuestiones que me ha suscitado la lectura del post y el comentario:

Además de usar la inteligencia artificial para proporcionar financiación o para conceder hipotecas

¿cabría la posibilidad de usar la Inteligencia artificial para la resolucón de pleitos civiles, e incluso penales, admnistrativos y laborales? ¿Preferiríamos que nos juzgase un ser humano o una inteligencia artificial?

¿preferiríamos una u otra si nos sintiésemos con razón o inocentes o bien culpables o carentes de razón?

¿Usarían los abogados un programa de Inteligencia Artificial como forma de predecir el resultado del pleito y saber si es viable interponer la demanda?

Por otro lado, ojalá el Prof. D. Enrique Dans haga un post que resuma la charla acerca de concesión de hipotecas mediante IA. Muchas gracias.

Que yo sepa un juez solo aplica la ley, incluyendo los famosos precedentes para casos dudosos. Una AI lo haría mucho mejor, sin sesgos y sin jurados como este ….»El TSJM ordena repetir un juicio de asesinato machista al revelar un miembro del Jurado que votó por la culpabilidad para irse antes a «casa» «

El esquema de machine learning es : Datos –> Análisis –> Decisión y bucle dentro de los datos.

Funcionando cierto tiempo, se alimenta únicamente de decisiones tomadas por sí mismo, puesto que las decisiones ajenas han sido eliminadas por el mal llamado algoritmo.

El sistema se refuerza a si mismo y no se puede comparar sus decisiones con otras, puesto que nunca las hay.

Poco a poco las decisiones humanas irán desapareciendo y el sistema AI será el único en alimentar su base de datos («dataset» para los que no manejan bien el castellano).

Se elimina por tanto la variedad y se produce una forma de endogamia por empobrecimiento sanguíneo.

Imaginese un momento que se confie a un sistema de AI la decisión de si hay que confiar todas las decisiones a un sistema de AI o si hay que contar también con los humanos. ¿Qué decisión tomaría entonces la AI? Pero ¿cómo sabrá el sistema si esta decisión es la correcta, o la mejor?, puesto que no habrá nada con qué comparar.

menos algoritmos y mas humanidad , ya empieza estar Bien! treinta años tras los lenguajes programas enseñando a las maquinas aprender y van dandodonos lecciones permanente en todo el ambito de la humanidad ,hipotesis si sera , del como hara , que conviene o no . Cuando aun empresa es fundamentada una buena decision estara por encima basada factores de lo humano actitud . Que sea un asqueante algoritmo denota el rumbo tomado ultima decada , hacia el estupidez presente .

El ambito humano maquinas deben apartar totalmente de indiscuirse ,medirle , acotarle y pre suponerle ,El lugar que corredsponde las maquinas es el puro virtual .ni Skypes , Whatsaap y medibles big data etc esta aqui hacer ningun bien . Hay apartarlas ya y revocarlas a donde no han debido transpasar .Al igual que la economia de atencion desplegada de los grandes algoritmos .

La mision en posicion con tegnologias es esta des-estupidizaje mas de ningun otra ,y la mal manipulacion empleo tiene esto . De otra manera a los pocos años siga desarrollo ciego intelencia artificial .El ser como persona va ser supeditado completamente por todo el sub recurso algoritmico que desconocemos