Mi columna de esta semana en Invertia se titula «Prohibir a los menores o prohibir el negocio que vive de engancharlos» (pdf), y trata sobre esa tentación política, cada vez más extendida, de abordar la relación entre adolescentes y redes sociales como si el problema pudiera resolverse simplemente levantando una barrera de edad, fijando una cifra redonda y anunciando una prohibición con tono solemne. Es una idea atractiva porque suena contundente, porque permite a los gobiernos presentarse como protectores de la infancia y porque convierte un problema complejo en una consigna fácilmente comunicable. Pero precisamente por eso conviene mirarla con cautela: cuando una cuestión profundamente estructural se traduce demasiado deprisa en un titular simple, lo normal es que estemos ante una solución aparente, no ante una solución real.

La Comisión Europea lleva tiempo trabajando esta cuestión con un enfoque bastante más sofisticado que el del simple veto generacional. En julio de 2025 publicó sus directrices para la protección de menores bajo el Digital Services Act, en las que habla no solo de contenidos nocivos, sino también de comportamientos problemáticos y adictivos, ciberacoso y prácticas comerciales perjudiciales. A la vez, presentó un prototipo de aplicación de verificación de edad, pensado como solución transitoria hasta la llegada de la identidad digital europea. España, además, no ha sido una mera espectadora: participa en ese despliegue y lleva tiempo intentando combinar protección de menores con garantías de privacidad, un equilibrio mucho más difícil y mucho más interesante que el habitual recurso a la prohibición retórica.

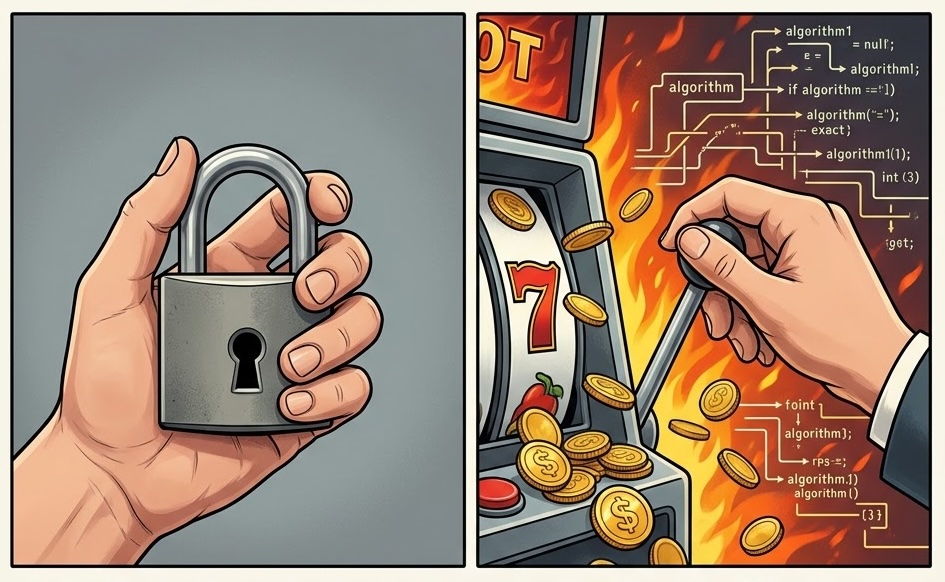

Ese es, en realidad, el punto central: el problema existe, pero no es exactamente el que muchos responsables políticos parecen querer describir. No estamos simplemente ante «menores usando redes», como si el daño proviniese de la mera exposición a una tecnología neutral. Estamos ante entornos diseñados deliberadamente para capturar atención, prolongar permanencia, fomentar comparación social, explotar impulsos y maximizar recurrencia. El foco, por tanto, no debería ponerse solo en la edad del usuario, sino en la arquitectura del servicio. Si el negocio depende de enganchar, de generar hábito, de convertir vulnerabilidad en tiempo de pantalla monetizable, entonces el verdadero objeto regulatorio no son únicamente los menores, sino el modelo económico que los convierte en materia prima conductual.

Además, la evidencia disponible dista mucho de justificar los atajos intelectuales con los que suele legislarse este asunto. Las autoridades sanitarias estadounidenses advirtieron ya de que no puede afirmarse que las redes sociales sean suficientemente seguras para niños y adolescentes, y pidió precisamente más transparencia, más responsabilidad y más datos. La OCDE, por su parte, plantea explícitamente una aproximación de «toda la sociedad», en la que administraciones, familias, escuelas, profesionales y plataformas compartan responsabilidad. Es decir, ni complacencia tecnológica ni histeria moral. Quien lea esos documentos con un mínimo de honestidad verá que ninguno avala la idea de que prohibir por edad, por sí solo, vaya a resolver el problema.

La investigación académica más seria tampoco encaja bien con el simplismo prohibicionista. Un estudio publicado en Nature Human Behaviour subraya que la relación entre redes sociales y salud mental adolescente no puede reducirse a una causalidad lineal y uniforme, y muestra que los efectos dependen mucho del perfil previo del menor, de su situación emocional y del tipo de uso. Y un estudio reciente en JAMA introduce un matiz decisivo: el problema más claramente asociado a ideación suicida, conductas suicidas y peores resultados de salud mental no era simplemente el tiempo total de pantalla, sino las trayectorias de uso adictivo. Dicho de otro modo: no basta con contar horas: hay que entender dinámicas de dependencia, compulsión, deterioro del sueño, afectación del rendimiento y pérdida de control. Eso obliga a pensar la regulación desde el diseño de los sistemas, no solo desde la puerta de entrada.

Por eso me parece tan problemática la facilidad con la que el debate público se desplaza hacia la verificación de edad y se olvida del resto. Verificar edad puede tener sentido en algunos contextos, sobre todo cuando se trata de acceso a contenidos manifiestamente inadecuados. La propia AEPD ha desarrollado principios razonables para hacerlo minimizando la identificación y protegiendo datos personales. Pero convertir esa herramienta en el centro absoluto de la política pública es otra cosa. Porque entonces dejamos intacto lo esencial: los sistemas de recomendación, el diseño persuasivo, la opacidad algorítmica, las notificaciones invasivas, el scroll infinito y la ingeniería conductual que define hoy a buena parte de las plataformas. Nos quedamos, como tantas veces, regulando la superficie y dejando intacto el subsuelo.

En España, además, este debate tiene una dimensión política especialmente significativa. Aquí existe una gran facilidad para convertir la protección de los menores en terreno de consenso simbólico, precisamente porque casi nadie se atreve a cuestionar públicamente una medida presentada como escudo generacional. Pero una democracia madura debería distinguir entre protección efectiva y pánico moral administrativamente elegante. La primera exige incomodar a las plataformas, auditar sus prácticas, imponer obligaciones técnicas, exigir interoperabilidad regulatoria y asumir conflictos jurídicos y económicos. El segundo consiste en anunciar límites de edad, multiplicar declaraciones solemnes y confiar en que la tecnología de verificación haga el resto. Una estrategia transforma el entorno, la otra simplemente desplaza la conversación.

En el fondo, la pregunta no es si hay que proteger a los menores. Eso, afortunadamente, no admite discusión. La pregunta es de qué queremos protegerlos exactamente. Si la respuesta es «de internet», estamos perdidos antes de empezar, porque internet no va a desaparecer de sus vidas. Si la respuesta es «de modelos de negocio que convierten la vulnerabilidad en beneficio y que se están haciendo cada vez peores«, entonces la conversación cambia por completo. Ya no se trata de vigilar al menor, sino de limitar al depredador. Ya no se trata solo de impedir el acceso, sino de rediseñar las condiciones del acceso. Y ya no se trata de una política de control de usuarios, sino de una política de control de plataformas. Lo lógico: en un entorno, Europa, que protege la privacidad como derecho fundamental, prohibir que haya empresas que nos espían a todas horas y venden nuestros intereses y patrones de comportamiento al mejor postor. Ahí es donde de verdad empieza el debate serio. Lo otro, por desgracia, se parece demasiado a legislar contra el síntoma… para no tener que tocar la enfermedad.

Muy bueno, sí señor

Por la protección de los menores se han aprobado barbaridades. Recordemos que en los 80 y 90 se quisieron banear los juegos de rol tipo «Dungeons and Dragons» por satánicos.

¿El efecto? Que algunos jóvenes perdieron su única forma de socializar por miedo a que su hobby se etiquetase como algo terrible, perdiendo así la única red de seguridad que les quedaba.

——

Reitero, el problema ni siquiera son estas plataformas (son parte importante) sino los padres que le dan al niño el «cacharro» con 8 años, sin filtros, ni reglas, ni control parental, ni acompañamiento ni educación.

Y claro, ahora intentar legislar en ese hueco que las familias han abierto es muy difícil. El padre está con los niños y saben que edades tienen de verdad y que pueden ver y que no.

El gobierno, el Sistema Operativo, las páginas web, el proveedor de internet y el servidor DNS no saben quien se conecta (neutralidad de la red) y así debe ser.

No podemos pedirle a los legisladores que nos arreglen la patata caliente que nosotros mismos nos hemos creado. Dejemos de dar móviles como chuches y controlemos lo que ven los niños.

Es más, no me trago el cuento de que «los niños saben más que los padres». Cualquier niño de 10 años hoy en día tiene padres de unos 35-45, que han crecido con Eriksson, Nokia, iPhone, Samsung y Xiaomi mientras usaban Windows 3.11, Windows 95, Windows 98SE, Windows XP, etc. – No son analfabetos digitales, son perezosos digitales.

Es más, si abren youtube les explica paso a paso como habilitar control parental y limitaciones de tiempo y de apps y que no permita que los niños lo desactiven sin pasar por una clave secreta.

¿Se puede legislar cómo debe funcionar una Red Social?

Por ejemplo:

– Restringir la cantidad de datos a recoger, parametrizable por el usuario y sin que suponga una merma en las prestaciones del servicio.

– Una RRSS debe ofrecer un sistema de seguimiento para añadir usuarios a los que sigues para saber qué publica.

– Una RRSS debe ofrecer un apartado Siguiendo en el que se mostrará todo los que hacen aquéllos a quien sigo sin, quitar ni añadir nada, en función de mis preferencias parametrizables, y sin que ningún algoritmo decida qué es más o menos interesante.

– Una RRSS puede ofrecer un apartado Te puede interesar en el que se muestren actividades de otros usuarios, guiado o no por un algoritmo en función de los datos recogidos por el servicio.

Tendrá un tiempo limitado de uso o de mensajes a mostrar para evitar el scroll infinito.

– ¿Un sistema eficiente para eliminar desinformación tras una denuncia verificada?

Ideas que se me ocurren al vuelo y que creo que es lo que básicamente buscamos en esos servicios.

¿Sería posible legislar algo así? ¿Sería legal este intrusismo en el funcionamiento de un servicio de RRSS?

Porque no se me ocurre otra forma de controlar lo que hace una RRSS más allá del dichoso control de edad. Porque desde luego que por propia voluntad ninguna empresa va a autolimitarse.

Hola,

Y los adultos ¿No podemos caer en los mismos comportamientos que los adolescentes?

Ya lo creo que sí. Esto es muy falso. Como tú dices, el problema es el diseño, y a mí como adulto también me hace falta saber que si entro en Instagram no están tratando de manipularme.

Igual que cuando entro en un restaurante asumo que sanidad los controla, me gustaría poder asumir que prácticas que pueden afectar a mi salud mental no están permitidas en las RRSS. Y eso no tiene que ver con mi edad.

Jaume.

¿Cómo era eso que dijo algún sabio? «Toda pregunta compleja tiene una respuesta simple… y falsa».

Cuando se recluyó a la infancia y adolescencia en centros específicos de control, llamados escuelas y colegios/institutos no era para darles educación y aprender con ella a se libres/autónomos… realmente era para que asumieran una forma de ver la realidad social que impidiera regenerarla. Se le llama domesticación humana.

Porque las crías humanas traen un biogén que los capacita (e incita) para ser regeneradores de la sociedad adulta dominante, que se ha ido deteriorando. Los adultos usan un sociogén para neutralizarlo. Y la tecnología está en el medio.

Muy interesante. Supuestamente la escuela serviría (en su incepción actual heredada de los colegios de señoritas británicos de la época victoriana) para democratizar el acceso al conocimiento y terminar con el sistema antiguo de maestro-discípulo imperante hasta hace pocos siglos y al que solo ciertos privilegiados podían acceder.

¿Cuál sería la alternativa que propondrías?

Tu lo has dicho: no va mas allá de una cohartada.

Una cohartada para legislar con un objetivo diferente. La justificación que se busca, acostumbra a invocar el miedo o un concepto moral de amplio concenso entre la ciudadanía.

Y todavía seguimos creyendo en el cuento de la democracia y las libertades. Nunca he negado que no hayan muchos funcionarios europeos que trabajen para ello. Pero de facto, la hoja de ruta marcada por las élites bien posicionadas en las instituciones es la contraria.

Muy ilustrativa es en este sentido, la reciente cartelería desplegada frente al cuartel general de Bruselas y a lo largo de otras localizaciones de la ciudad.

Regular esta bien, pero si no se acompaña de un esfuerzo pedagógico o educativo: sospechoso.

Si la preocupación fuera realmente los menores, se materializaría con muchas más iniciativas legislativas y no todas precisamente relacionadas con la vida digital.

Lo que se acostumbra muchas veces desde Bruselas, aun suponiendo buenas intenciones, se puede ilustrar con la analogía siguiente. Ante una espiral de muertes violentas por arma de fuego, se legisla una política anti-delincuencia, que consiste en la prohibición a salir a la calle sin un chaleco antibalas. Y si no lo llevas puesto: multa.

El gran problema es siempre el mismo, ¿Quien controla al controlador?

Cuando el Gobierno, (no importa de que color), establece e un sistema de control/censura, de contenidos, siempre ocurre lo mismo, la justificación «es por tu bien» pero el objetivo es acallar a los disidentes,