Tras la decisión de las autoridades municipales de San Francisco de prohibir el uso de tecnologías de reconocimiento facial para determinar la identidad de una persona basándose en un vídeo o fotografía, una segunda ciudad, Somerville, en Massachusetts, se une a ella con medidas similares.

La reacción de las ciudades norteamericanas sorprende por el hecho de adelantarse a otros países y entornos tradicionalmente más concienciados y respetuosos con todos los temas relacionados con la privacidad: en Europa, la posible regulación del tema está aún en la fase previa, en su análisis por parte de comisiones de expertos, aunque todo apunta que las conclusiones serán similares: la prohibición del uso de algoritmos de reconocimiento facial para llevar a cabo actividades de vigilancia masiva. En Londres, sin embargo, se están haciendo pruebas con su uso, e incluso se ha multado a personas por cubrirse la cara para evitar ser reconocidos por las cámaras.

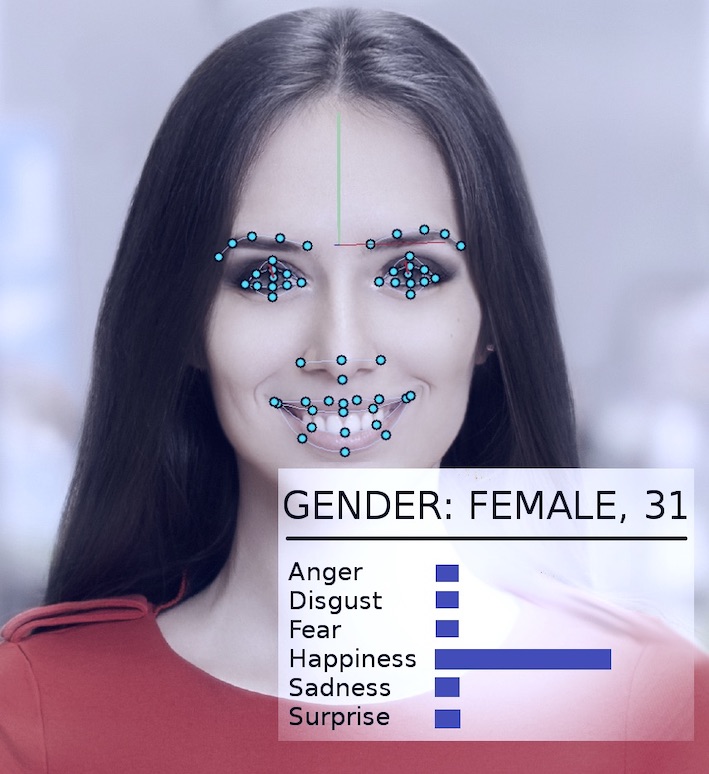

A medida que la tecnología de reconocimiento facial se hace más sencilla, más escalable, más precisa y su adopción más ubicua, nos sitúa ante un dilema moral: una cosa es utilizarla para aplicaciones que nos hacen la vida más sencilla y sobre las que tomamos decisiones libremente, como desbloquear nuestro smartphone o nuestro ordenador, embarcar más rápido en un avión o pasar más rápidamente por el control de pasaportes de un aeropuerto, y otra tener que aceptar de forma obligada que nuestras ciudades se conviertan en entes que nos espían y monitorizan donde estamos y qué hacemos en todo momento. Las reacciones de los manifestantes de Hong Kong, utilizando máscaras y trucos como ponerse pegatinas en distintos lugares de la cara para confundir a los sistemas de reconocimiento facial, utilizando billetes de metro de un solo uso en lugar de su tarjeta de transporte personal, o comunicándose con tarjetas SIM recién adquiridas en lugar de con las habituales, deberían alertarnos sobre la distopía que se nos viene encima si permitimos que la tecnología sea aplicada hasta el límite en ese sentido.

Empresas tecnológicas como Amazon han manifestado claramente, a pesar de la oposición de sus empleados, no estar dispuestas a dejar de vender su tecnología de reconocimiento facial a los gobiernos que lo soliciten. Mientras, surge también una corriente tecno-fatalista que simplemente opina que la tecnología de reconocimiento facial está aquí para quedarse, y que a pesar de que no todos sus usos nos gusten, tendremos que aceptarla necesariamente como parte del panorama habitual que nos rodea, como un signo de los tiempos. Sin embargo, este tipo de visión resignada choca con la realidad: la vigilancia masiva nunca ha funcionado, termina generando sistemas que nos vigilan a todos menos a los que tienen algo que ocultar, y nos roba un espacio y unas libertades que considerábamos fundamentales. La experiencia nos demuestra que el penoso argumento del “si no tengo nada que ocultar, no tengo nada que temer” es algo que, simplemente, no funciona.

¿Cómo deberíamos plantearnos la regulación de las tecnologías de reconocimiento facial? ¿Desplegarla, pero restringir su uso a cuestiones excepcionales siempre solicitadas mediante una orden judicial? ¿No permitir su despliegue y su uso? ¿Permitir su uso con una serie de excepciones adecuadamente consensuadas dentro de un contexto social determinado? ¿Cómo afrontar un reto social que tenemos ya prácticamente encima?

This article was also published in English on Forbes, «Do we need to recognize that we have a facial recognition problem?«

Perternezco al grupo tecno-fatalista « la tecnología de reconocimiento facial está aquí para quedarse . Pero a la vez pertenezco al grupo que lo que más le preocupa son los sistemas biométricos de control, porque el resto de los sistemas de control, controlan una interfaz, una IP, el DNI, la matrícula del coche, una tarjeta de crédito,… en el supuesto que esa intefaz se corresponde a determinada persona.

Basta que la persona utilice otra interfaz o una copia «fake» de su interfaz para que el control se haga imposible, .como hacen en Honk Kong comunicándose con tarjetas SIM recién adquiridas

Contra el control biométrico, poco podemos hacer. No podemos fácilmente cambiar nuestra huella dactilar, ni el rostro, ni el ADN, ni el iris. Cualquier sistema de control basado en esos datos, es altamente fiables, pero por eso mismo, peligroso en manos indeseables, y terribles si esas manos indeseables son las de tu propio gobierno.

Pero mi opinión es que se impondrán y sobre todo, en donde haya gobiernos indeseables.

a estas alturas, creo que la cuestión es más amplia que lka que se plantea al final. La sociedad enjambre ya está aquí, y lo que se puede hacer es diseñar la sociedad en si más que regular el uso de la tecnología. Si no lo hacemos así, la regulación nos llevará a la pérdida de posibilidad de diseño amplio y colaborativo de la sociedad. Al fin, la tecnología acaba escapando de la regulación si quien la emplea tiene poder suficiente.

A mi tampoco me gusta que una máquina conduzca por mi, me diga la serie que tengo que ver o que la propuesta de valor de las «fintech» o «insurtech» sea analizar mis patrones de pagos u otras actividades. Pero mira, hay gente que lo defiende con todas sus fuerzas.

Así que la cuestión está en acordar dónde ponemos la línea de lo aceptable. Pero me parece que va a ser muy difícil ponernos de acuerdo.

En Europa la regulación del tema lleva reflejada en la GDPR desde 2016, e impide la recolección de datos biométricos sin el consentimiento previo, o de forma indiscriminada, ni por el gobierno, ni por las empresas. Como ya he comentado un potorrón de veces, previamente a que EE.UU. asimilase la GDPR como modelo de protección de datos de los consumidores.

En Sudáfrica y un buen número de países de otros continentes hay leyes incluso más estrictas.

En el cuerpo legal, no existe un lugar para esos escenarios distópicos tan bonitos, ya que como todo el mundo sabe, las películas no son el mundo real.

La multa fue por alboroto o resistencia, al no identificarse a requerimiento de un policía; en la mayoría de los países democráticos los agentes de policía no pueden multar por no mostrar una identificación.

‘Técnicamente’, la cara no es un documento de identificación, por lo que la policía de Londres podría haber incurrido en un delito.

(Ni tampoco puede tomar huellas digitales de forma indiscriminada en la calle. Ni ADN.)

–

El desastre de la privacidad… y su tendencia a empeorar – 453138

Reconocimiento facial: cuando la tecnología avanza demasiado rápido – 453005

Tu fe en la GDPR es enternecedora.

Me pregunto si de acuerdo con la GDPR esto será legal, pero legal o no se anuncia abiertamente.

El sistema de control por huella dactilar es uno de los métodos más seguros que existen hoy en día para la identificación de trabajadores en el control de presencia en el puesto de trabajo, o de control de acceso a áreas restringidas en las instalaciones de una empresa o institución.

No cambia gran cosa, ya hace mucho tiempo que series de tv como «El fugitivo» o «El increible Hulk» uno que huye por todo el pais capitulo a capitulo, no serian creibles pues su foto esta en todos los dispositivos

El día que el reconocimiento facial sirva para decidir, que infantes se van a quedar sin comer o ser maltratados por adultos, morir en guerras de lo más variopinto o «viajando» hacia «la libertad»… entonces, maldito reconocimiento facial.

Rntiendo que el reconocimiento facial, puede llegar a descubrir en el futuro que infantes se han quedado sin comer, o cuales han sido maltratados. pero descubrir los que se vayan a quedarse sin comer o ser maltratados. exigirán una capacidad adivinatoria que dudo que llegue a tener, ni incluso en un futuro cercano.

Hola Enrique, como todo lo nuevo, tiene sus escépticos y sus defensores, el tiempo pondrá todo en su lugar. Algo muy claro es que todo, llevado al extremo es malo para todos. Un cuchillo, puede servir para cortar el pan o para causar daño a una persona, pero ahí en la cocina lo tenemos todos.

Saludos,

Sinceramente me gustaría hacer un mundo mejor en el que los cambios tuvieran como eje principal al ser humano desde un punto de vista humanístico e ignorar tanta proclama de «visión de futuro» basada en el nuevo hype terminológico «disrupción» promovido para alcanzar un liderazgo tecnológico en el que te hace ser el amo del mundo y el gran negocio de unos pocos y lo peor de todo, el discurso mesiánico en el que si no te apuntas eres un tonto, un retrasado y troglodita o peor aún un ignorante y casposo que es incapaz de ver por donde apunta el futuro.

El problema de este enfoque humanístico en el que el que el individuo es el rey y señor de este planeta es que no resulta atractivo si no lo planteas como un negocio atractivo y viable al menos a medio plazo. En eso las grandes corporaciones es en lo último que piensan desgraciadamente.

Siempre apoyaré la actitud conservadora y más tranquila que tiene la Unión Europea al respecto, por ejemplo el tema drones o VTC en el que se busca un mayor equilibrio de fuerzas y paz social anteponiendolo a la búsqueda del liderazgo.

Estar alerta, si. I+D+I también. Imponerlo a toda costa y aceleradamente, no.

Coincido con @gorki en lo aterrador que supone ceder los datos biomedicos, hoy por hoy por ejemplo por tener una aplicación gratuita en el que administrar tus sesiones de deporte, niveles de colesterol o azucar para estar sano la cantidad de datos que esa aplicación recopila tarde o temprano acabará en compañías de seguros de vida. Nunca he sido partidario de la mamonada del iWatch tampoco.

@agremon, coincido totalmente con tu planteamiento «…y lo que se puede hacer es diseñar la sociedad en si más que regular el uso de la tecnología. Si no lo hacemos así, la regulación nos llevará a la pérdida de posibilidad de diseño amplio y colaborativo de la sociedad»

¡Excelente Enrique!:

«La vigilancia masiva nunca ha funcionado, termina generando sistemas que nos vigilan a todos menos a los que tienen algo que ocultar, y nos roba un espacio y unas libertades que considerábamos fundamentales. La experiencia nos demuestra que el penoso argumento del “si no tengo nada que ocultar, no tengo nada que temer” es algo que, simplemente, no funciona.»

Las cámaras de video-vigilancia ya están plenamente implementadas en las capitales de provincia ¿dar un paso más con reconocimiento facial automatizado? No.

Todo esto de la inteligencia artificial empieza a ser como un videojuego, no se a donde vamos a ir a parar. Aunque en teoría progresar es bueno todo depende de como se utilice la tecnología. Mi cámara de fotos ya detecta cuando el retratado sonríe o no para que dispare sola. Y esto no es nada en comparación con lo que habla este post. Sólo deseo que esta tecnología se use bien.