El primer análisis de la experiencia con el iPhone 8 tiene que estar dedicado necesariamente a la cámara. Probé el terminal brevemente, durante una comida con unos amigos, y sin duda, fue la cámara lo que robó completamente mi atención.

Tiré unas pocas fotografías a unos amigos que estaban sentados enfrente – no comparto esas fotos por una cuestión de elemental discreción, así que he recurrido a recortar algunas de las de las demos de la página de Apple, pero el efecto era exactamente el mismo, y puede verse también claramente en este artículo: una sensación completamente diferente a la que he tenido con cualquier otra cámara, de smartphone o no, y que se corresponde más con otro tipo de experiencia. Realmente, la primera vez que percibo la potencia de una serie de algoritmos intentando entender lo que pretendo hacer, identificando de manera más que razonable la fotografía, midiendo y evaluando las condiciones, y permitiéndome obtener el efecto prometido.

¿Es esto fotografía? Decididamente, es otro tipo de percepción de la fotografía. Con cualquier otra cámara, obtener un bokeh bien hecho, un viñeteado completo del fondo o una iluminación determinada y mínimamente cuidada de una cara son técnicas no necesariamente al alcance de cualquiera, que exigen una medición cuidadosa y unas nociones razonables de conceptos como la profundidad de campo. Cuando nos llevamos esa experiencia de una cámara convencional a un smartphone, la aplicación de muchas de esas técnicas se complica o precisa de una cierta adaptación, que hasta el momento, no siempre ofrecía los mejores resultados. Sin duda, las cámaras de los smartphones han mejorado mucho, pero por el momento, y de una manera generalizada, su uso se centraba más en el obtener un recuerdo de lo que estaba delante del objetivo que en plantearse algo más sofisticado. En medio de un restaurante, cuando fotografío la etiqueta de una botella de vino para recordarla posteriormente, puedo llegar a buscar un efecto de desenfoque del fondo que la rodea o incluso puedo lanzarle un flash sin piedad a corta distancia y viñetearla toscamente si tengo cierto cuidado de no provocar reflejos que convertirían la imagen en impresentable, pero hasta ahora, era ahí donde terminaban la mayoría de las pretensiones.

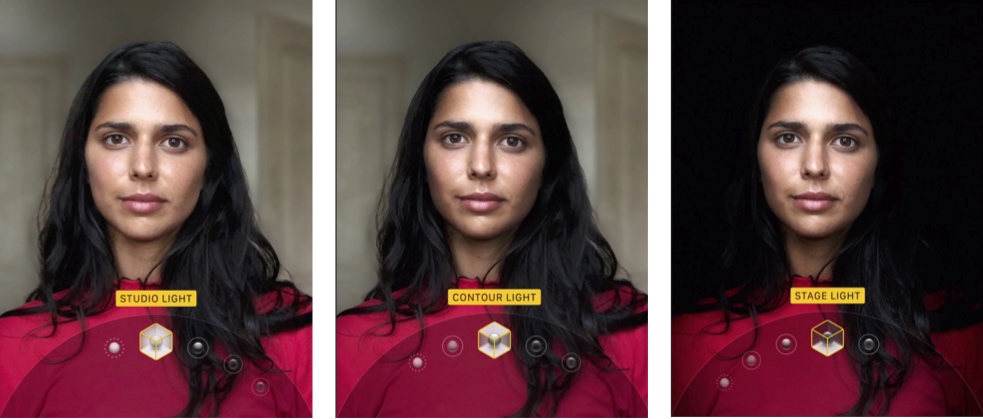

Ahora, cualquier persona, absolutamente cualquiera, puede hacer una fotografía y, simplemente jugando con un menú de cinco opciones, alternar entre iluminación natural, de estudio, de contorno, de escenario o de escenario en B/N. Los efectos son dramáticos, impresionantes, incluso algo exagerados, pero sin duda, sirven su función: a partir de ahora nos hartaremos de ver muchísimas fotografías hechas con este tipo de efectos. La imagen final almacena, además, los parámetros resultantes para que se pueda jugar con ellos tras el disparo, lo que equivale en cierto sentido a lo que sería la aplicación de filtros en determinadas apps.

Pero lo interesante, más allá de los resultados obtenidos, es la forma de llegar a ellos: por primera vez no hablamos de efectos obtenidos mediante la gestión de un parámetro determinado (brillo, contraste, saturación, nitidez, etc.) o provocando la aplicación de una capa a una zona determinada (desenfoque, tilt-shift, viñeta, etc.), sino del uso de una serie de algoritmos que interpretan la imagen, y gestionan esa serie de parámetros para obtener un resultado determinado. La cámara pasa de tomar una imagen, a «entender» esa imagen, a «saber» qué es una cara, qué partes están delante o detrás en la imagen, qué zonas puede el usuario tener interés en destacar, en desenfocar o en ocultar. Sinceramente, han sido unos pocos minutos jugando, pero me ha parecido brutal. Es como si de repente hubiese dejado de tener una cámara en las manos y tuviese un ordenador completo (como de hecho lo tengo, porque eso es hoy en día un smartphone) con un programa de edición sofisticado que, además, toma decisiones – si quiero, claro – por mí y me genera los resultados adecuados.

Obviamente, no es perfecto. Los viñeteados resultan a veces muy radicales y pueden perder detalles, como una nariz en un perfil o cualquier forma que sobresalga un poco de lo que el algoritmo interpreta que es una cara, los efectos se aplican de manera algo más errática en fotos de grupo, y surgirán, sin duda, una cierta cantidad de situaciones en los que la aplicación resulte completamente absurda o directamente grotesca. Pero la sensación, de nuevo tras unos pocos minutos, es impresionante. Que un algoritmo valore una imagen y decida cómo aplicar algunos de los efectos considerados más populares proporciona una sencillez tal a la hora de obtener esos efectos que, por un lado, dará lugar a una brutal vulgarización de su uso, pero por otro, a una gran cantidad de usuarios satisfechos con las prestaciones de su smartphone, a que cualquiera se sienta «casi» un profesional. Un efecto que en cierta medida logró en su momento Instagram con sus filtros – de ahí su éxito inicial, o, a otro nivel, Camera+… tras filtrar adecuadamente una foto y sentirte como un crack de la fotografía, lo inmediato es querer compartirla en una red que te genera dosis de dopamina con cada Like – pero que ahora va mucho más allá gracias a la aplicación de machine learning al proceso.

Un desarrollo bien planteado, llamativo y que, si has tenido un mínimo contacto con el desarrollo de algoritmos de machine learning, permite entender muchas cosas. Muy pronto, en sus pantallas.

This post is also available in English in my Medium page, “The new iPhone: it’s a smartphone with a camera, Jim, but not as we know it…»

Para fotografías «aparentes», es decir, que se vean bien en un móvil y similar. si que da el pego, pero a la hora de la verdad, si amplias un poco la fotografía o la intentas llevar a papel fotográfico de ciertas dimensiones, ya cantan mucho.

Aún hay Reflex para rato, al menos, mientras no se logre violar las las leyes de la física con un sensor minúsculo y unos «cristales» ridículos. Esto es como todo, hay gente que no nota diferencia entre escuchar música con pérdida o sin pérdida, o ya puestos, entre comer una hamburguesa con una Pepsi, a tomar un chuletón con un Muga. En realidad de eso se trata, de tolerancia ante la mediocridad.

Abducido

Cuando leo este tipo de artículos sobre cualquier cámara de cualquier movil, sea el movil más ultracaro del planeta, -me da igual que me da lo mismo-, me parto el pecho al recordar cómo están llenas de churretes, polvo, huellas dactilares, rayas, y hasta algún trozo de una loncha de chorizo, las ópticas de dichas cámaras con las que se pretende tomar tan excelentes y rutilantes fotos; es que me parto de la risa tirado por el suelo.

Pues así la gente saca fotos sin molestar siquiera en comprobar el grado de limpieza de la óptica alojada en un dispositivo que, como ya dije aquí mismo, amén de ser una de las mayores estafas (por los precios), encima presume de ser el diseño con peor ergonomía en la historia de la humanidad. Ay, señor…